如何使用Python实现softmax函数的反向传播?

发布于2023-05-08 阅读(0)

发布于2023-05-08 阅读(0)

扫一扫,手机访问

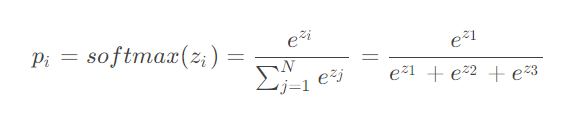

反向传播求导

可以看到,softmax 计算了多个神经元的输入,在反向传播求导时,需要考虑对不同神经元的参数求导。

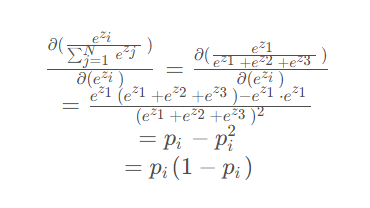

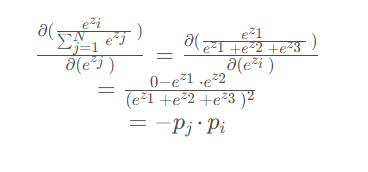

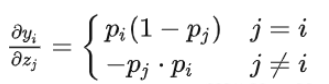

分两种情况考虑:

当求导的参数位于分子时

当求导的参数位于分母时

当求导的参数位于分子时:

当求导的参数位于分母时(ez2 or ez3这两个是对称的,求导结果是一样的):

代码

import torch import math def my_softmax(features): _sum = 0 for i in features: _sum += math.e ** i return torch.Tensor([ math.e ** i / _sum for i in features ]) def my_softmax_grad(outputs): n = len(outputs) grad = [] for i in range(n): temp = [] for j in range(n): if i == j: temp.append(outputs[i] * (1- outputs[i])) else: temp.append(-outputs[j] * outputs[i]) grad.append(torch.Tensor(temp)) return grad if __name__ == '__main__': features = torch.randn(10) features.requires_grad_() torch_softmax = torch.nn.functional.softmax p1 = torch_softmax(features,dim=0) p2 = my_softmax(features) print(torch.allclose(p1,p2)) n = len(p1) p2_grad = my_softmax_grad(p2) for i in range(n): p1_grad = torch.autograd.grad(p1[i],features, retain_graph=True) print(torch.allclose(p1_grad[0], p2_grad[i]))

本文转载于:https://www.yisu.com/zixun/783989.html 如有侵犯,请联系zhengruancom@outlook.com删除。

免责声明:正软商城发布此文仅为传递信息,不代表正软商城认同其观点或证实其描述。

免责声明:正软商城发布此文仅为传递信息,不代表正软商城认同其观点或证实其描述。

产品推荐

-

售后无忧

立即购买>- DAEMON Tools Lite 10【序列号终身授权 + 中文版 + Win】

-

¥150.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Ultra 5【序列号终身授权 + 中文版 + Win】

-

¥198.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Pro 8【序列号终身授权 + 中文版 + Win】

-

¥189.00

office旗舰店

-

售后无忧

立即购买>- CorelDRAW X8 简体中文【标准版 + Win】

-

¥1788.00

office旗舰店

-

正版软件

正版软件

- Visio 隐藏属性如何读取解析

- 本文详解MicrosoftVisio.vsdx文件中Shape属性的“隐藏”机制,指出Visible标志与公式驱动行为是导致Python解析结果与Visio实际显示不一致的核心原因,并提供可靠的数据提取策略。

- 13分钟前 0

-

正版软件

正版软件

- Java Lambda封装方法调用全攻略

- Java不支持直接将“带参方法调用”字符串化后动态存入变量并统一调用,但可通过函数式接口(如Supplier、Function等)配合Lambda实现类型安全、简洁且零反射的延迟调用封装。

- 28分钟前 0

-

正版软件

正版软件

- Java Swing字母猜谜游戏多次尝试实现方法

- 本文详解如何用事件驱动方式替代错误的嵌套循环,实现带提示(过高/过低)和次数限制(如3次)的字符猜测游戏,重点纠正字符串比较、状态管理及Swing响应式编程误区。

- 43分钟前 0

-

正版软件

正版软件

- Spring Data JPA仓库层实现字符串字段排序的函数式方法

- 本文介绍在SpringDataJPA中,无需编写原生SQL或JPQL,仅通过方法命名约定即可在Repository接口中实现字符串字段的升序/降序排序。

- 58分钟前 0

-

正版软件

正版软件

- 宝塔跨服务器快速传输网站源码方法

- 用rsync+SSH密钥免密登录可实现秒级增量同步,关键在于预置公钥、使用绝对路径、添加--delete-avz参数及排除动态文件;需停用宝塔站点并确保跨云网络与防火墙配置正确。

- 1小时前 15:45 0

最新发布

-

1

1

-

2

2

-

3

3

- C语言中\n是什么意思?换行转义字符详解

- 213天前

-

4

- 探析Spring Boot框架的优点和特色

- 529天前

-

5

- 深入比较PyCharm社区版和专业版的功能

- 467天前

-

6

- 专家观点:谷歌是否会继续支持Golang的探讨

- 443天前

-

7

7

- Python实战教程:批量转换多种音乐格式

- 1075天前

-

8

- 如何在在线答题中实现试卷的自动批改和自动评分

- 903天前

-

9

9

- 解决Python安装失败的问题

- 453天前

相关推荐

热门关注

-

- Xshell 6 简体中文

- ¥899.00-¥1149.00

-

- DaVinci Resolve Studio 16 简体中文

- ¥2550.00-¥2550.00

-

- Camtasia 2019 简体中文

- ¥689.00-¥689.00

-

- Luminar 3 简体中文

- ¥288.00-¥288.00

-

- Apowersoft 录屏王 简体中文

- ¥129.00-¥339.00