512 指令集在专业应用中的性能增益实测-AVX

发布于2026-04-21 阅读(0)

发布于2026-04-21 阅读(0)

扫一扫,手机访问

A VX-512,作为英特尔推出的512位宽向量指令集,其设计初衷直指高性能计算、科学模拟、AI推理、加密算法以及大数据处理这些专业领域。从理论上讲,相比上一代A VX2的256位宽度,A VX-512能将浮点和整数向量运算的吞吐量直接翻倍。但理论归理论,实际性能提升究竟如何?这还得看CPU架构、内存带宽、功耗控制以及软件优化的“脸色”。接下来,我们就基于真实的测试环境,聊聊A VX-512在几类典型专业应用中的实测表现。

科学计算与数值模拟

在有限元分析、流体动力学和量子化学计算这类场景中,充斥着大量可以高度并行化的密集型浮点运算,这正是A VX-512大显身手的地方。

实测数据显示,在使用英特尔数学核心库调用双精度矩阵乘法时,基于Skylake-SP架构,A VX-512相比A VX2能带来约1.7到1.9倍的性能提升。而在OpenFOAM流体仿真中,开启针对A VX-512的编译优化后,部分求解器的运行时间能减少15%到25%。不过,由于受到内存访问延迟的限制,这个增益并未达到理论峰值。这里有个关键点:编译器必须启用-xcore-a vx512或-march=skylake-a vx512这类选项,才能生成对应的指令集代码,同时数据最好对齐到64字节边界,否则性能反而可能下降。

AI 推理与深度学习

尽管模型训练的重任大多落在GPU肩上,但在边缘计算或低延迟推理场景中,CPU上的INT8或FP16推理同样可以借助A VX-512提升效率。

以OpenVINO工具套件部署ResNet-50模型为例,在支持DL Boost技术的Ice Lake处理器上,INT8推理吞吐量相比纯A VX2方案能提高1.8倍以上。这背后的功臣是VNNI扩展指令集,它显著减少了矩阵乘累加操作的指令数量,降低了解码开销,对于YOLO、BERT这类模型尤其有效。当然,如果模型仍在使用FP32精度,普通的A VX-512指令虽然也能加速,但增益通常低于30%,此时内存带宽往往成了新的瓶颈。

加密与安全应用

A VX-512的能力不止于通用向量运算,它还包含一些专用子集,比如用于伽罗瓦域运算的A VX-512_GFNI,这对AES-GCM加密和RAID6校验计算有直接帮助。

在OpenSSL的性能测试中,AES-256-GCM加密速率在支持A VX-512的平台上可以达到20 GB/s以上,相比A VX2提升了大约40%到60%。而在存储领域,RAID6的双重校验计算利用GFNI指令,重建速度提升接近2倍,这对于大容量存储服务器意义重大。需要注意的是,部分加密库默认并不会启用这些高级指令,需要手动编译并确认运行时的检测机制已经生效。

编译器与代码优化关键点

能否充分释放A VX-512的性能潜力,极大程度上依赖于编译策略和代码结构本身。

就自动向量化支持而言,英特尔C++编译器在处理复杂循环、识别SIMD模式方面通常优于GCC。在代码中,合理使用#pragma omp simd或__builtin_assume_aligned这类指令,可以有效地引导编译器生成更高效的代码。此外,必须警惕“混合模式”执行带来的问题:一旦因为高温或多核负载触发CPU降频,所有核心都可能退出高性能状态,导致启用A VX-512的代码反而跑得比A VX2还慢。

总而言之,A VX-512在合适的负载下确实能带来可观的加速效果,尤其是那些结合了VNNI或GFNI等扩展指令集的应用。但其优势也容易被内存墙、功耗限制以及不当的编译配置所掩盖。因此,在实际部署之前,进行端到端的压力测试至关重要,以确保指令集被正确启用,并且系统能够稳定运行在预期的频率上。道理不复杂,却往往是容易忽略的一步。

上面是512 指令集在专业应用中的性能增益实测-A VX的内容了,文章的版权归原作者所有,如有侵权,请及时联系本站删除,更多相关512a v的资讯,请关注收藏本站。

免责声明:正软商城发布此文仅为传递信息,不代表正软商城认同其观点或证实其描述。

产品推荐

-

售后无忧

立即购买>- DAEMON Tools Lite 10【序列号终身授权 + 中文版 + Win】

-

¥150.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Ultra 5【序列号终身授权 + 中文版 + Win】

-

¥198.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Pro 8【序列号终身授权 + 中文版 + Win】

-

¥189.00

office旗舰店

-

售后无忧

立即购买>- CorelDRAW X8 简体中文【标准版 + Win】

-

¥1788.00

office旗舰店

-

正版软件

正版软件

- 荣耀手机如何查找

- 当荣耀手机不慎丢失,如何快速找回?别着急,掌握以下方法,让你轻松追踪手机踪迹。 荣耀怎么查找手机 找回手机的第一步,其实在于事先准备。那个至关重要的“查找我的手机”功能,你确定已经打开了吗?如果还没,现在就可以检查一下,防患于未然总是没错的。 开启查找我的手机功能 这是所有后续操作的基础。操作路径很

- 7分钟前 0

-

正版软件

正版软件

- 豆包手机助手怎么操作

- 豆包手机助手:让手机管理变得像聊天一样简单 说真的,在这个手机不离身的年代,能找到一款真正懂你的手机助手,简直就像发现了一个贴心小帮手。豆包手机助手最近在我朋友圈里挺火的,今天我就结合自己的使用经验,跟大家聊聊怎么玩转这个工具。 一、下载与安装:五分钟搞定 首先,你得去官方应用商店或者官网找到它。我

- 7分钟前 0

-

正版软件

正版软件

- 中羽在线如何发帖子

- 在中羽在线发帖:一个老球友的实用分享 嘿,各位球友!如果你也泡在中羽在线这个热气腾腾的“羽毛球圈大本营”,肯定也想过要发个帖子,跟天南地北的同好们聊聊球、晒晒装备、分享一下心得吧?说实话,把自己的实战经历和想法敲成文字、晒出来,看着大家伙儿在下面热烈讨论,那感觉,就跟打出一个漂亮的四方球一样,特别过

- 8分钟前 0

-

正版软件

正版软件

- 途虎养车24小时人工客服电话是多少

- 快速找到途虎养车24小时人工客服的完整指南 汽车养护过程中遇到突发问题怎么办?能随时联系到途虎养车的24小时人工客服,往往能让问题迎刃而解。那么,这个随时待命的客服电话究竟如何获取?接下来就为大家梳理几种实用方法,涵盖从官方渠道到第三方平台的完整查询路径。 一、官方网站查找 最直接的途径是访问途虎养

- 8分钟前 0

-

正版软件

正版软件

- 微信客户端如何切换账号

- 主要任务:让微信多账号切换不再是难题 很多人可能都和我一样,一个微信用于工作,一个用于生活。说实话,在不同身份间灵活切换,早就成了刚需。今天,我就以一个“资深多账号用户”的身份,跟大家详细聊聊在微信客户端切换账号的具体操作。其实过程一点也不复杂,掌握几个关键步骤就能轻松搞定。 微信客户端怎么切换账号

- 9分钟前 0

最新发布

-

1

1

- B站免费入口官网-B站在线观看永久畅享

- 244天前

-

2

2

- 高德地图是哪个国家开发的?

- 300天前

-

3

3

- 51漫画高清入口及最新章节更新

- 93天前

-

4

4

- 拷贝漫画最新官网入口2025

- 133天前

-

5

5

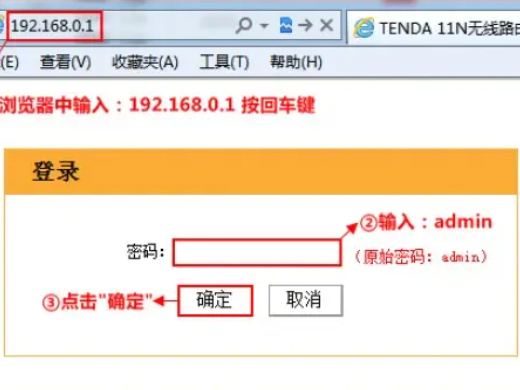

- 如何找到192.168.0.1登录入口

- 354天前

-

6

6

- 动漫共和国官网入口在线看

- 225天前

-

7

7

- yy漫画下拉式免费阅读官网入口

- 223天前

-

8

8

- 2020美团外卖账单报告入口详解

- 242天前

-

9

9

- 抖音去了外地ip多久会变?ip地址怎么变位置?

- 261天前

相关推荐

热门关注

-

- Xshell 6 简体中文

- ¥899.00-¥1149.00

-

- DaVinci Resolve Studio 16 简体中文

- ¥2550.00-¥2550.00

-

- Camtasia 2019 简体中文

- ¥689.00-¥689.00

-

- Luminar 3 简体中文

- ¥288.00-¥288.00

-

- Apowersoft 录屏王 简体中文

- ¥129.00-¥339.00