李海大学等五所高校联手:AI能否像老师一样看懂学生的错误思路?

发布于2026-04-26 阅读(0)

发布于2026-04-26 阅读(0)

扫一扫,手机访问

AI能读懂孩子的数学草稿吗?这项研究给出了耐人寻味的答案

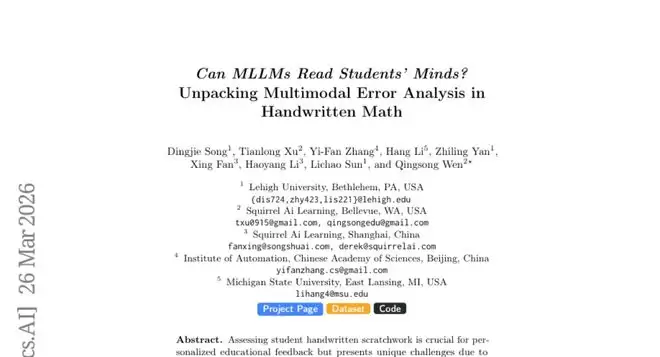

2026年3月,一份由李海大学、松鼠AI学习、中科院自动化所等五所知名院校联合完成的研究,被发布在arXiv预印本平台上(编号:arXiv:2603.24961v1)。这项研究做了一件挺有意思的事:它第一次系统地探究了那些“多才多艺”的多模态大语言模型,到底能不能像人类老师一样,读懂学生手写数学作业里的错误。想刨根问底的读者,不妨用上面的编号去搜搜看原文。

想象这么一个画面:孩子的数学作业本上,写满了数字,涂涂改改,算式东倒西歪。家长看了可能一头雾水,但经验丰富的老师却能一眼看穿——错在哪里?为什么错?孩子的思路卡在哪个环节了?现在,研究人员正试图让人工智能也获得这种“透视”能力。

一、破译手写密码:AI面临的第一道难题

孩子的手写草稿,对AI来说无异于一部天书。数字“7”带个小勾,除号写得像加号,涂改的墨团掩盖了关键步骤……这些对人类老师而言,经过训练和经验的积累尚可解读,但对AI模型来说,却是第一道难以逾越的鸿沟。

研究发现,现有的AI在处理手写数学符号时,表现得像个“近视眼”。举个例子,学生在计算4÷35时,可能因为不熟悉小数除法,在过程中错误地移动了小数点,最终得出一个相距甚远的答案8.75。人类老师能顺着草稿的笔迹,还原出学生的思维路径,判断出这是小数计算技能薄弱所致。然而,AI往往连那些潦草变形的数字和符号都识别不准,更别提追踪背后跳跃的逻辑了。

更复杂的是格式问题。数学草稿从来不是印刷体,上面有随意画的圈、箭头、旁注。这好比在一张凌乱的地图上找路线,人类老师能凭经验分辨哪些是正式步骤,哪些是草稿涂鸦;而AI则很容易被这些“噪声”干扰,完全误解学生的意图。

数据很能说明问题:即便是表现最好的AI模型,视觉识别错误率也高达36%。这意味着超过三分之一的情况,AI连学生写了什么都没看清,后续的分析自然无从谈起。

二、从表象到本质:错误分类的精妙艺术

即使AI勉强“看清”了内容,更大的挑战才刚刚开始:理解错误的本质。这有点像中医辨证,同样是“答案错误”,背后的“病因”却各不相同。

研究团队将数学错误精细地分成了七大类。比如,“程序性错误”是步骤执行出了岔子;“计算错误”是具体运算时“手滑了”;而“逻辑推理错误”最为棘手,好比下棋时战略思路从根上就偏了,步步皆错却看似合理。

不同年龄段的学生,错误模式也大不相同。小学生的错误主要集中在题目理解和基础计算上,这两类加起来能占到70%,像刚学做菜的新手,不是看错菜谱就是放错调料。中学生则更多地在复杂计算和概念理解上栽跟头。

有趣的是,AI对不同类型错误的诊断能力也参差不齐。对于有明确外在特征的“抄写错误”,AI识别尚可;但面对需要深度理解的“逻辑推理错误”,AI就显得力不从心。

三、思维追踪:AI能否读懂学生的心思

识别符号是技术活,理解思维则是认知层面的高难度动作。这就像侦探破案,不能只看现场,还得推演出完整的作案动机和过程。

来看个实际案例。题目问:“小明4分钟做了35道题,平均每道题用多少分钟?”正确答案应是4÷35≈0.11分钟。但有学生答了8.75。人类老师扫一眼草稿就能发现,学生把除数和被除数弄反了,这暴露了他对“平均时间”概念的误解。

AI在处理这类问题时,常犯两种毛病:一是“过度推理”,自己脑补出学生根本没犯的错误;二是“表面诊断”,只能指出答案不对,却说不到错误的根子上。

另一个反直觉的发现是:AI在处理小学低年级简单题目时的表现,有时反而不如处理中学复杂题目。原因可能在于,小学生的书写更随性,解题思路也更跳跃,缺乏规范的步骤展示,这让习惯结构化工序的AI更难以捉摸。

四、数据背后的故事:1720份真实作业的启示

这项研究最可贵的一点,是它基于真实的、原汁原味的学生作业。团队从海量样本中,最终筛选出1720份涵盖一到九年级的数学草稿,覆盖了数字、方程、几何、应用、统计五大领域。

数据标注采用了“人机协作”的严谨模式:先让AI初判,再由五位资深的数学老师最终审核修正,确保标签的可靠性。这个过程,有点像医院的专家会诊。

数据分析揭示了一些鲜明的趋势:小学阶段,理解和计算错误是重灾区;到了中学,随着知识变难,概念理解错误的比例显著上升。此外,人类专家之间对于错误判断的一致性超过了90%,这为评估AI设定了一个明确的高标准。

五、AI大比拼:16个模型的表现如何

研究团队拉来了16位“AI教师”同台竞技,阵容豪华,从开源翘楚到商业明星,包括Qwen2.5-VL、GPT-4o、Gemini 2.0 Flash等。

比拼结果可谓喜忧参半。在“错误原因解释”这项核心任务上,表现最优的模型(o4-mini)准确率在70%左右。但请注意,人类老师的标杆在87%以上。这意味着,最顶尖的AI仍落后人类近20个百分点。

而在更精细的“错误分类”任务上,差距被进一步拉大:最好的AI准确率仅40%出头,人类老师则轻松超过78%。这好比一个医生,或许能看出你生病了,但具体是什么病,却经常误诊。

六、失败案例解剖:AI到底错在哪里

为了找到病根,研究团队深度剖析了100个典型失败案例。

首要问题依然是“看不清”(视觉识别失败,占36%)。学生写的“-3÷(-6)=1/2”,在AI眼里可能变成了别的符号组合,第一步就错了。

其次是“看不懂格式”(占15%)。草稿上的箭头、圈画、涂改,这些人类老师能自动过滤的辅助信息,却经常让AI晕头转向。

此外,“幻觉”(占16%)和“错位解读”(占17%)也很常见。AI有时会无中生有,编造学生没犯的错误;或者虽然看到了所有步骤,却无法将它们按正确的逻辑顺序串联起来,还原不出真实的思考轨迹。

七、不同数学领域的挑战差异

AI的能力也存在“偏科”现象。它在几何与测量、统计与概率这类步骤相对规范、答案相对唯一的领域表现较好。然而,一旦遇到方程与函数这类需要多步、复杂逻辑推理的题目,AI就颇为吃力了。

应用数学题目则呈现两极分化:对于有固定套路的“行程问题”,AI尚能应对;一旦题目涉及现实建模和开放假设,AI就容易“死机”。这恰好暴露了当前AI在处理真实世界复杂性和灵活性上的短板。

八、年级差异揭示的认知模式

另一个有趣的发现是AI表现的“年级效应”。在解释错误原因时,AI的表现随年级升高而轻微下降,可能是被高年级题目的内在复杂性难住了。

但在给错误分类时,趋势却完全相反:AI对高年级作业的分类准确率明显更高。原因在于,中学生的解题过程更规范、步骤更清晰、书写更工整——这相当于给AI提供了一份更标准的“普通话”文本,当然比解读小学生的思维“方言”要容易。

九、商业化模型与开源模型的较量

在这场比拼中,商业化模型(如o4-mini)整体上显著领先于开源模型,这背后是数据质量、算力投入和工程优化的综合优势。尤其是在需要深度推理的任务上,那些专门强化了推理能力的模型(无论是商业还是开源的)表现都更突出,这说明理解学生错误,光靠“看”还不够,核心在于“想”。

当然,开源模型也有亮点。比如在某些特定领域(如统计概率),个别开源模型的表现甚至不输商业模型,显示了其在垂直领域训练的独到之处。

十、实际应用的前景与挑战

尽管目前AI还不能媲美人类老师,但其应用前景已然清晰。首先,它可以成为老师的“超级助教”,高效完成作业的初筛,让老师能聚焦于最需要人工干预的复杂案例。

其次,在推动个性化学习上潜力巨大。AI若能精准诊断每个学生的独特思维误区,就能生成量身定制的学习报告和练习,实现“对症下药”。

当然,挑战依然严峻。技术上,手写识别与深度推理能力有待突破;教育理念上,则需警惕过度依赖技术而削弱师生间宝贵的人文互动与情感连接。如何让AI真正成为“助攻”而非“主角”,是未来教育智能化必须深思的课题。

说到底,这项研究揭示了一个核心事实:理解人类写在纸上的、充满跳跃和涂改的思维过程,其复杂程度远超我们的想象。从潦草字迹到逻辑误区,这中间需要跨越的不仅是技术鸿沟,更是认知鸿沟。

不过,这项研究的价值恰恰在于此。它搭建了一个坚实的评估基准,提供了高质量的真实数据集,为后续的探索铺平了道路。或许在不远的将来,每个孩子真的能拥有一位永不疲倦、即时反馈的AI学习伙伴,那无疑将为教育的个性化与公平性,打开一扇全新的大门。

Q&A

Q1:ScratchMath数据集包含了哪些内容?

A:它包含了1720份来自中国中小学的真实数学手写草稿,覆盖一到九年级,涉及数字与表达式、方程与函数等五大数学领域。每一份都包含了原始手写过程和经过专家标注的错误分类信息。

Q2:当前最先进的AI在理解学生数学错误方面表现如何?

A:即使是顶级模型,在解释错误原因上的准确率也仅在70%左右,远低于人类老师的近90%水准;在错误分类任务上,差距更大,AI约40%的准确率与人类近80%的水平相比,仍有很长一段路要走。

Q3:AI在分析学生数学错误时主要面临哪些困难?

A:主要困难有三:一是视觉识别关,难以准确辨认潦草、不规范的手写符号;二是格式理解关,容易被涂改、圈画等非标准布局干扰;三是逻辑推理关,难以深入追踪并理解学生多步骤解题过程中的根本性思维误区。

免责声明:正软商城发布此文仅为传递信息,不代表正软商城认同其观点或证实其描述。

产品推荐

-

售后无忧

立即购买>- DAEMON Tools Lite 10【序列号终身授权 + 中文版 + Win】

-

¥150.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Ultra 5【序列号终身授权 + 中文版 + Win】

-

¥198.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Pro 8【序列号终身授权 + 中文版 + Win】

-

¥189.00

office旗舰店

-

售后无忧

立即购买>- CorelDRAW X8 简体中文【标准版 + Win】

-

¥1788.00

office旗舰店

-

正版软件

正版软件

- 机械革命推出 2026 款耀世 16 Ultra 游戏本:水冷双烤 300W,OLED 屏

- 机械革命推出2026款耀世16 Ultra游戏本:水冷双烤300W,OLED屏 准备刷新你对高性能游戏本认知的设备来了。最近,机械革命正式上架了2026款耀世16 Ultra游戏笔记本电脑。这台新机的看点很足,它搭载了全新的英特尔酷睿Ultra 9 290HX Plus处理器,显卡方面则一步到位,提

- 6分钟前 0

-

正版软件

正版软件

- 荣耀 MagicBook 14 笔记本配备双 M.2 2280 固态硬盘插槽、92Wh 大电池

- 荣耀新款MagicBook全系拆解:双M.2与92Wh电池成标配,性能与续航的“双保险” 最近,荣耀中国区的高管在微博上分享了一组MagicBook 14的拆机实拍图,信息量不小。看来,荣耀对今年新品的内部堆料自信满满,直接用“毫不妥协”来形容。 从图片看,这台笔记本的内部布局相当规整。最显眼的莫过

- 7分钟前 0

-

正版软件

正版软件

- 荣耀 MagicBook Pro 16 / 14 2026 款笔记本将上线全新 Magic 视界,支持 YOYO AI 智慧搜索等

- 荣耀 MagicBook Pro 16 / 14 2026 款前瞻:新交互、强性能与长效续航 关于即将亮相的荣耀 MagicBook Pro 16 / 14 2026 款笔记本,官方又释放了值得玩味的新消息。这一次的焦点,落在了交互体验的革新上。 据官方预热,该系列笔记本将搭载一个名为“全新 Mag

- 8分钟前 0

-

正版软件

正版软件

- 荣耀 MagicBook Pro 14 笔记本规格公布:第三代酷睿 Ultra X9 处理器、3.1K 超清屏,1.37kg 重

- 荣耀 MagicBook Pro 14 笔记本规格公布:第三代酷睿 Ultra X9 处理器、3.1K 超清屏,1.37kg 重 就在今天,荣耀通过官方微博揭晓了新款 MagicBook Pro 14 笔记本的部分核心规格。对于一直关注高性能轻薄本市场的朋友来说,这份“预告”信息量不小,值得细看。

- 8分钟前 0

-

正版软件

正版软件

- 28 核移动端“巨兽”,英特尔 "Nova Lake HX" 处理器规格曝光

- 英特尔“Nova Lake HX”处理器规格曝光:28核移动端“巨兽”来袭 又有新料了。根据消息人士 @jaykihn0 的最新爆料,英特尔计划在其下一代移动高性能平台 —— 很可能被命名为酷睿 Ultra 400HX 的“Nova Lake HX”系列中,准备了两套截然不同的核心配置方案。 高规格

- 8分钟前 0

最新发布

-

1

1

- 在哪里可以找到手机相片收藏

- 519天前

-

2

2

- 详细解读I7-14650HX的性能评测数据

- 526天前

-

3

3

- 如何选择DP接口版本: 1.2还是1.4?

- 537天前

-

4

4

-

5

5

- 华为GT4和Watch4,哪个更好?

- 829天前

-

6

6

- 骁龙芯片的型号与天玑9400相当?

- 545天前

-

7

7

-

8

8

-

9

9

- 三星“约谈”联发科 A系列智能手机有望搭载其5G芯片

- 2323天前

相关推荐

- 真“秉烛夜游”!省电天才用蜡烛驱动游戏机

- 倍思卡片磁吸 Air 开启预约:299 元,号称首个航天级安全充电宝

- OPPO 120W 超能舱超级闪充移动电源 15000 官宣,已通过新国标验收

- 明年 4 月 1 日实施:移动电源新国标正式公开发布,要求产品标明建议使用年限

- 怒喵 AM Infinity .97 鼠标上市:针对亚洲人手型微调 3%,1280 元起

- 12T 网盘 + 每天 1000 次云添加:迅雷超级会员 11 元 / 月官方发车

- 创新推出 PROJECT WATCHER 直播摄像头套件:提供 35mm 定焦及 20-55mm 变焦双机位,629 元

- 京东京造推出“黄金气囊手机磁吸支架”:内嵌 1 克 Au 99.99 投资金片,1199 元

- OPPO Find X9s Pro 手机部分规格曝光:6.32 英寸小直屏,后置横向大矩阵设计

热门关注

-

- Xshell 6 简体中文

- ¥899.00-¥1149.00

-

- DaVinci Resolve Studio 16 简体中文

- ¥2550.00-¥2550.00

-

- Camtasia 2019 简体中文

- ¥689.00-¥689.00

-

- Luminar 3 简体中文

- ¥288.00-¥288.00

-

- Apowersoft 录屏王 简体中文

- ¥129.00-¥339.00