网站为什么会降权-网站降权的预防措施有哪些

发布于2026-04-28 阅读(0)

发布于2026-04-28 阅读(0)

扫一扫,手机访问

网站降权:原因剖析与系统性预防策略

对任何一个网站运营者而言,最令人焦虑的情况之一,莫过于某天发现网站在搜索引擎中的排名悄然下滑,流量也随之萎缩。这种情况,通常被称为“网站降权”。它并非无缘无故发生,背后往往指向一系列可追溯、可修正的问题。弄明白降权背后的逻辑,并建立起系统的预防机制,无疑是网站长期健康发展的基石。

降权原因:那些常见的“踩坑”行为

降权从来不是单一因素导致的,但以下几个原因,几乎占据了绝大多数案例。不妨对照看看,你的网站是否无意中触碰了这些红线。

1. 内容质量堪忧

搜索引擎的核心任务,是为用户筛选出高质量、有价值的信息。如果你的网站充斥着大量拼接、抄袭、或者毫无信息增量的“水文”,那么被算法判定为低质量站点而降低权重,几乎是必然结果。原创度和用户价值,是内容不可逾越的生命线。

2. 关键词堆砌的陷阱

为了快速获得排名,有些做法会在页面中强行、密集地插入关键词,导致语句不通,阅读体验极差。这种刻意的优化在今天的搜索引擎看来,无异于刻舟求剑,不仅无效,还会被直接认定为作弊手段,触发降权。记住,内容始终是为“人”服务的,而不是为“机器”填充的。

3. 外部链接的“双刃剑”

外链建设是SEO的重要一环,但方法错了,危害巨大。通过购买大量来源可疑、主题毫不相关的垃圾链接来试图提升权重,这种急功近利的做法早已被搜索引擎重点打击。一旦被识别,降权处罚会来得又快又狠。高质量的外链,必须是自然、相关且权威的。

4. 混乱的网站结构

想象一下,如果一个商场导航混乱、通道堵塞,顾客必定寸步难行。搜索引擎的爬虫访问你的网站时,感受也是如此。不清晰的导航、混乱的页面布局、糟糕的链接结构,都会阻碍爬虫的有效抓取和索引,导致大量页面无法获得应有的权重。结构问题,是网站的基础性内伤。

5. 服务器稳定性的隐患

服务器是网站的“家”。如果这个家三天两头地宕机、访问缓慢甚至瘫痪,那么无论是真实用户还是搜索引擎爬虫,都会频繁地“吃闭门羹”。长期不稳定的访问体验,会向搜索引擎传递一个明确的负面信号:这个网站不值得信赖。随之而来的,便是权重的下调。

预防措施:构建稳健的网站免疫系统

知道了病因,预防就有了方向。与其在降权后焦头烂额地补救,不如从一开始就构建起一套稳健的“免疫系统”。

1. 死磕优质内容

这是所有预防措施中,最核心、最持久的一条。与其费尽心思研究算法的漏洞,不如回归本质:坚持产出原创、有深度、能切实解决用户问题的内容。当你的内容成为用户真正需要的东西时,搜索引擎自然会给予青睐。

2. 关键词的自然融合

关键词应该像盐一样,自然地融入到内容的“汤”里,提升鲜味,而不是像一堆石子,咯得读者难受。写作时,优先考虑内容的流畅性与相关性,关键词的布局应当水到渠成,服务于表达,而非相反。

3. 经营高质量的外链生态

外链建设要转向“价值吸引”模式。通过持续产出具有引用价值的行业报告、深度分析或实用工具,吸引其他网站主动链接你。同时,可以主动与行业内权威、相关的优质站点进行内容合作或资源互换。记住,质量远重于数量。

4. 优化网站结构与体验

确保网站拥有清晰的导航树和面包屑路径,让用户和爬虫都能轻松理解网站框架和自身位置。合理的内部链接策略,不仅能传递权重,更能提升用户的停留时长和浏览深度。一个逻辑清晰、易于浏览的网站结构,是良好排名的物理基础。

5. 投资稳定的服务器

在服务器上省钱,往往是最昂贵的浪费。选择信誉良好、技术可靠的服务器提供商,确保网站的访问速度、稳定性和安全性。这笔投资,直接关乎网站在搜索引擎眼中的“健康评分”。

6. 保持活跃与更新

一个长期不更新的网站,就像一个无人打理的店面,会逐渐失去生机。定期发布新的文章、更新产品信息、优化旧内容,这些行为都在向搜索引擎表明:这个网站是活跃的、有价值的,值得被频繁抓取和重新评估。

7. 紧跟规则,规避风险

搜索引擎的算法并非一成不变,其公开的指南(如Google的《网站站长指南》)是运营必须遵守的基本法。密切关注核心算法的重大更新,理解其背后的意图——通常是打击作弊、提升用户体验。让自己的优化策略与搜索引擎的大方向保持一致,是避免政策性风险的根本。

总而言之,避免网站降权不是一个临时性的技术动作,而是一场围绕“用户体验”这个核心展开的、系统性的长期运营。它要求我们从内容创作、技术架构、外部关系到持续运营的每一个环节,都秉持专业和诚信的原则。只有这样,网站才能在搜索引擎的浪潮中稳扎稳打,实现真正可持续的发展。

免责声明:正软商城发布此文仅为传递信息,不代表正软商城认同其观点或证实其描述。

产品推荐

-

售后无忧

立即购买>- DAEMON Tools Lite 10【序列号终身授权 + 中文版 + Win】

-

¥150.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Ultra 5【序列号终身授权 + 中文版 + Win】

-

¥198.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Pro 8【序列号终身授权 + 中文版 + Win】

-

¥189.00

office旗舰店

-

售后无忧

立即购买>- CorelDRAW X8 简体中文【标准版 + Win】

-

¥1788.00

office旗舰店

-

正版软件

正版软件

- Soul个性化广告怎么关闭-Soul个性化广告关闭途径

- 轻松关闭Soul个性化广告,告别打扰,回归纯粹社交 在享受Soul社区乐趣的同时,是不是总感觉那些精准“猜中”你心事的广告有点太过“贴心”?别急,想要一个清爽纯净的社交环境,其实只需要几个简单的步骤,就能关闭个性化广告推荐。下面这份操作指南,帮你拿回信息流的自主权。 第一步:找到设置入口 首先,打开

- 3分钟前 0

-

正版软件

正版软件

- 如何便捷访问苹果壁纸制作网页-苹果壁纸制作网页便捷访问的方法

- 你是否为找不到心仪的苹果壁纸而烦恼? 想让你的苹果设备桌面瞬间变得独特又美观?现在,一个简单高效的方法就能满足你的所有想象——通过专门的网页工具,轻松制作出只属于你的苹果壁纸。 丰富多样的壁纸资源 首先,资源库是它的底气。这个平台汇聚了海量的壁纸素材,覆盖面之广,几乎能满足所有审美偏好。你是偏爱山川

- 3分钟前 0

-

正版软件

正版软件

- 如何直接进入网易邮箱网页版-网易邮箱网页版怎样直接进入

- 轻松直达:开启高效邮件之旅,从网易邮箱网页版开始 如今,数字信息流转的速度越来越快,电子邮箱早已跳出“收发工具”的范畴,变成了我们工作、学习和生活的核心枢纽。众多选择中,网易邮箱凭借其稳定可靠的性能、清晰易用的界面和不断丰富的功能,赢得了大量用户的长期信赖。今天,我们就来聊聊如何绕过烦琐步骤,快速切

- 4分钟前 0

-

正版软件

正版软件

- 当当网会员登录中心 当当网账号注册页面入口

- “当当网会员登录中心在哪?账号注册页面入口怎么找?”——这可能是很多新用户打开浏览器后的第一个疑问。别急,这篇指南将为你清晰梳理从注册到使用的完整路径,让你快速上手。 官网入口其实非常直接:https://www.dangdang.com/。记住这个地址,一切就从这里开始。 账户创建流程简洁直观 整

- 4分钟前 0

-

正版软件

正版软件

- 职业小知识最新答案1.18 蚂蚁新村职业小知识今日答案1.18

- 职业小知识最新答案1.18 蚂蚁新村职业小知识今日答案1.18 今天蚂蚁新村职业小知识的题目,带我们回到了那个名士风流的魏晋时代。题目问的是:以下哪首古琴曲因魏晋名士嵇康临刑前索琴弹奏而名扬千古?这个问题,可以说是直指中国音乐史上一段最为悲壮传奇的篇章。 蚂蚁新村职业小知识1.18答案汇总 正确答案

- 5分钟前 0

最新发布

-

1

1

- B站免费入口官网-B站在线观看永久畅享

- 251天前

-

2

2

- 高德地图是哪个国家开发的?

- 307天前

-

3

3

- 51漫画高清入口及最新章节更新

- 100天前

-

4

4

- 拷贝漫画最新官网入口2025

- 140天前

-

5

5

- 动漫共和国官网入口在线看

- 232天前

-

6

6

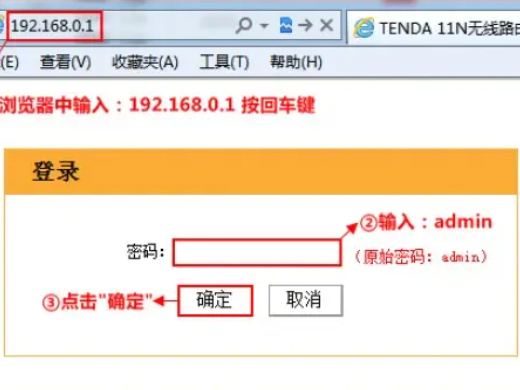

- 如何找到192.168.0.1登录入口

- 361天前

-

7

7

- yy漫画下拉式免费阅读官网入口

- 230天前

-

8

8

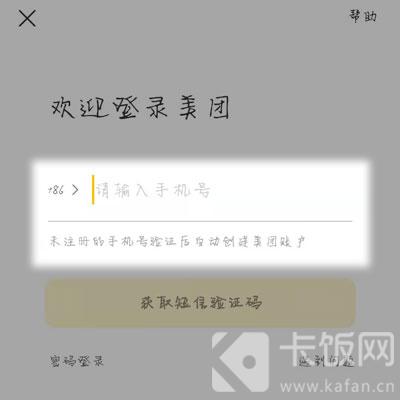

- 2020美团外卖账单报告入口详解

- 249天前

-

9

9

- 抖音去了外地ip多久会变?ip地址怎么变位置?

- 268天前

相关推荐

热门关注

-

- Xshell 6 简体中文

- ¥899.00-¥1149.00

-

- DaVinci Resolve Studio 16 简体中文

- ¥2550.00-¥2550.00

-

- Camtasia 2019 简体中文

- ¥689.00-¥689.00

-

- Luminar 3 简体中文

- ¥288.00-¥288.00

-

- Apowersoft 录屏王 简体中文

- ¥129.00-¥339.00