Debian Python并发编程解决方案

发布于2026-05-01 阅读(0)

发布于2026-05-01 阅读(0)

扫一扫,手机访问

Debian 上 Python 并发编程实战方案

一 环境准备与基础

想在 Debian 系统上玩转 Python 并发?准备工作其实很简单。首先,建议使用 Python 3.8 或更高版本。基础安装只需一行命令:sudo apt update && sudo apt install -y python3 python3-pip。之后,通过 pip 安装你需要的第三方库,比如 pip3 install aiohttp gevent requests-futures。

那么,Python 并发编程有哪些常见的“武器库”呢?简单梳理一下:

- 多线程 (threading):最适合处理 I/O 密集型任务,比如网络请求、文件读写。不过,受制于 GIL,它对纯 CPU 计算任务的提升就比较有限了。

- 多进程 (multiprocessing):这是绕过 GIL 限制的利器,专门用来对付 CPU 密集型任务。

- 异步 (asyncio):基于单线程事件循环,在应对海量并发 I/O 场景时,资源消耗极低,效率惊人。

- 线程/进程池 (concurrent.futures):提供了一个高级的统一接口,让任务的提交和结果回收变得异常方便。

- 协程库 (gevent / eventlet):基于 greenlet 的协作式并发,对 I/O 密集型应用友好,有时能让你以极低的成本改造现有同步代码。

二 常用并发模型与最小示例

理论说再多,不如看代码。下面我们直接切入实战,看看几种主流模型的核心用法。

多线程 + 线程池(I/O 密集)

适用场景:网络请求、文件读写这类“等待型”任务,需要轻量级并发时。

核心要点:使用 ThreadPoolExecutor 来管理线程生命周期是明智之举,它能有效避免频繁创建和销毁线程带来的开销。

示例代码:

from concurrent.futures import ThreadPoolExecutor

import time

def task(n):

time.sleep(0.2)

return n * n

with ThreadPoolExecutor(max_workers=4) as pool:

results = list(pool.map(task, range(8)))

print(results) # 输出:[0, 1, 4, 9, 16, 25, 36, 49]

多进程(CPU 密集)

适用场景:计算密集型任务,比如大规模数值计算、图像处理、数据压缩。

核心要点:可以使用 Process 或更便捷的 ProcessPoolExecutor。这里有个关键细节:在类 Unix 系统上,启动多进程的代码必须放在 if __name__ == ‘__main__’: 保护块下,这是为了避免子进程的无限递归。

示例代码:

from multiprocessing import Process, cpu_count

import time

def worker(i):

s = sum(x*x for x in range(10**6))

print(f”worker {i} done, sum={s}”)

if __name__ == ‘__main__’:

procs = [Process(target=worker, args=(i,)) for i in range(cpu_count())]

for p in procs: p.start()

for p in procs: p.join()

异步 asyncio + aiohttp(高并发 I/O)

适用场景:需要处理成千上万个并发连接时,例如高性能爬虫、API网关、实时通信服务。

核心要点:全程使用 async/await 语法;务必复用 ClientSession 以利用连接池;通过 asyncio.Semaphore 等工具控制并发度,防止把目标服务器或自身资源打满。

示例代码(限制并发数为100):

import asyncio, aiohttp

async def fetch(session, sem, url):

async with sem:

async with session.get(url, timeout=10) as r:

return await r.text()

async def main():

urls = [“https://httpbin.org/delay/1”] * 200

sem = asyncio.Semaphore(100)

async with aiohttp.ClientSession() as sess:

tasks = [fetch(sess, sem, u) for u in urls]

await asyncio.gather(*tasks)

asyncio.run(main())

协程 greenlet(I/O 密集、低侵入改造)

适用场景:当你已经有一套成熟的同步代码,希望以最小的改动成本来提升 I/O 并发能力。

核心要点:在程序入口处调用 monkey.patch_all() 打上“猴子补丁”,它会将标准库中的阻塞式 I/O 调用自动替换为协作式版本,从而实现“伪异步”。

示例代码:

from gevent import monkey; monkey.patch_all()

import gevent

def worker(i):

gevent.sleep(0.2)

return i*i

jobs = [gevent.spawn(worker, i) for i in range(8)]

gevent.joinall(jobs)

print([j.value for j in jobs])

混合模型:在异步中运行阻塞函数

适用场景:构建在异步框架(如 FastAPI)的服务中,偶尔需要调用一个 CPU 密集型或同步阻塞的第三方库。

核心要点:使用 loop.run_in_executor 将阻塞任务丢到后台的线程池或进程池中执行,从而避免阻塞整个事件循环,保证异步服务的响应性。

三 选型与性能要点

了解了各种工具,如何根据实际场景做出最佳选择呢?这里有几个关键决策点。

- 任务类型与模型选择:

- I/O 密集型:优先考虑

asyncio/aiohttp或线程池。当并发连接数极大时,asyncio在内存和线程开销上的优势会非常明显。 - CPU 密集型:毫不犹豫地选择多进程或

ProcessPoolExecutor。如果是在异步服务中遇到计算瓶颈,可以结合run_in_executor实现混合并发。 - 混合型任务:可以采用“异步处理 I/O,进程池处理计算”的策略,并通过

concurrent.futures进行统一的任务编排。

- I/O 密集型:优先考虑

- 连接与容错:

- 务必设置合理的连接池大小与超时时间(例如 aiohttp 的

TCPConnector,requests 的Session适配器与重试机制)。对于可能失败的请求,实现限速与重试逻辑是保障稳定性的关键。

- 务必设置合理的连接池大小与超时时间(例如 aiohttp 的

- 并发度控制:

- 线程或进程数并非越多越好。对于 CPU 密集任务,通常设置为 CPU 核心数或核心数+1;对于 I/O 密集任务,则需要根据网络带宽、磁盘速度或下游服务的承载能力,通过逐步压测来找到最优值。

- 同步与共享:

- 多线程间共享内存时,必须使用

Lock、Condition、Queue等同步原语来避免竞态条件。多进程间通信,则需依赖Queue、Pipe或共享内存等机制。

- 多线程间共享内存时,必须使用

- GIL 认知:

- 需要明确的是,GIL 使得同一时刻只有一个线程能执行 Python 字节码。因此,面对 CPU 密集任务,多进程是首选;而对于 I/O 密集任务,线程或协程则完全够用,不必过分担忧 GIL。

四 分布式与进阶方案

当单机性能达到瓶颈,或者需要更强大的任务调度能力时,就该考虑分布式方案了。

- 任务队列与分布式并发:

- 使用

Celery搭配Redis或RabbitMQ作为消息袋里,可以实现任务的解耦与横向扩展。这套方案特别适合需要定时执行、失败重试、跨多机调度以及结果回写的复杂场景。 - 最简示例:

- 安装:

pip3 install celery redis - 创建

celery_app.py:from celery import Celery app = Celery(‘tasks’, broker=‘redis://localhost:6379/0’, backend=‘redis://localhost:6379/0’) @app.task def add(x, y): return x + y - 启动 Worker:

celery -A celery_app worker -l info - 调用任务:

add.delay(4, 6).get(timeout=5)

- 安装:

- 使用

- 高并发爬虫实践:

- 目标是发起成千上万请求?那么

asyncio + aiohttp是当仁不让的首选。务必配合连接池、请求限速、智能重试和超时控制。使用Semaphore来限流是防止被封 IP 的常规操作。

- 目标是发起成千上万请求?那么

- 异步调用与超时/异常:

- 使用

asyncio.gather(return_exceptions=True)可以收集所有任务的结果,即使其中部分失败也不会影响其他任务。为每个任务设置asyncio.wait_for超时,是避免因个别慢请求导致整个系统“雪崩”的有效手段。

- 使用

免责声明:正软商城发布此文仅为传递信息,不代表正软商城认同其观点或证实其描述。

产品推荐

-

售后无忧

立即购买>- DAEMON Tools Lite 10【序列号终身授权 + 中文版 + Win】

-

¥150.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Ultra 5【序列号终身授权 + 中文版 + Win】

-

¥198.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Pro 8【序列号终身授权 + 中文版 + Win】

-

¥189.00

office旗舰店

-

售后无忧

立即购买>- CorelDRAW X8 简体中文【标准版 + Win】

-

¥1788.00

office旗舰店

-

正版软件

正版软件

- 怎样在Debian中调试Golang程序

- 在Debian系统中调试Golang程序 想在Debian系统里高效地调试Golang程序吗?Delve调试器绝对是你的不二之选。它功能强大,专为Go语言设计,能让你像外科手术一样精准地定位代码问题。下面,我们就来一步步搞定它的安装和使用。 第一步:安装Delve 首先,得确保你的系统已经装好了Go

- 10分钟前 0

-

正版软件

正版软件

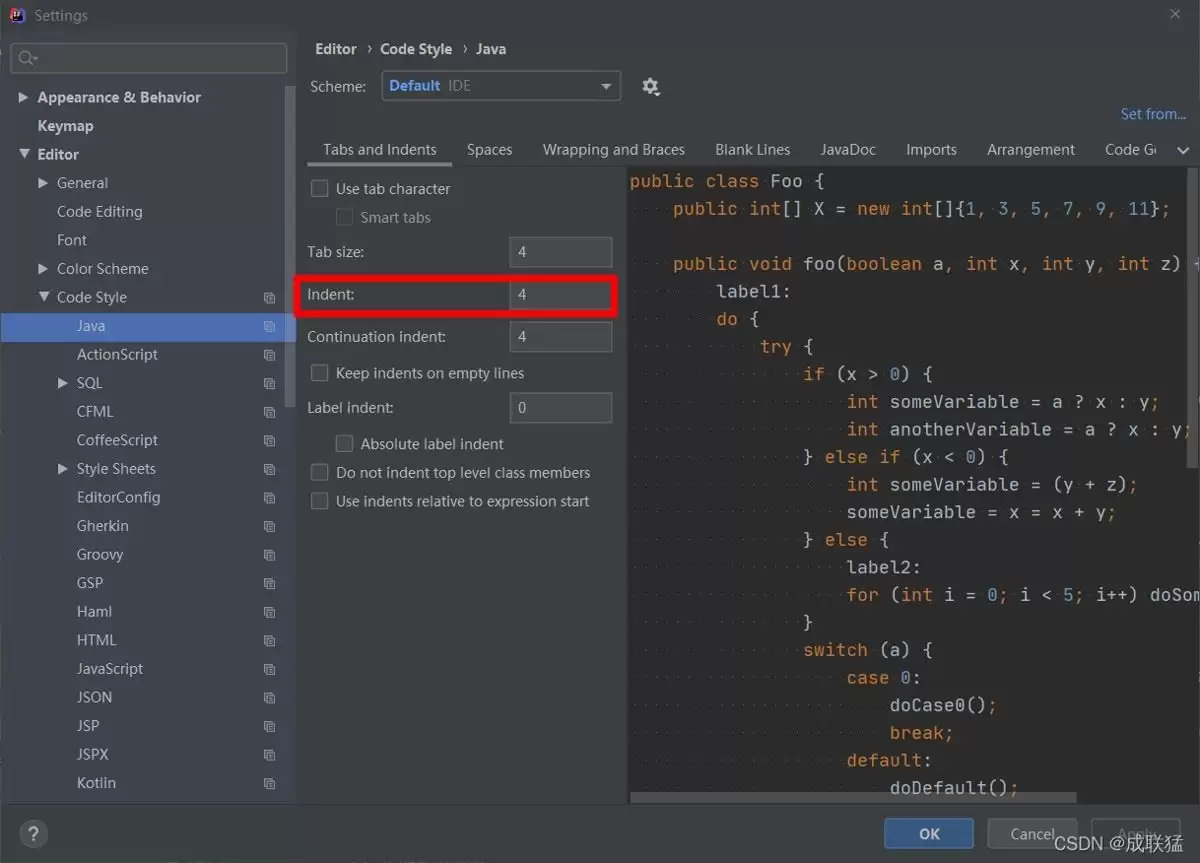

- idea设置回车换行缩进空格数为4的实现方式

- 首先在设置里设置 很多开发者习惯将代码缩进设置为4个空格,这能让代码结构看起来更清晰。在IntelliJ IDEA里,你通常会先到“设置”(Settings)里找到“编辑器”>“代码风格”,把制表符和缩进大小都调成4。这步操作,相信大家都轻车熟路了。 但是发现回车换行时 问题来了:设置改好后,满怀期

- 11分钟前 0

-

正版软件

正版软件

- Debian上如何优化Golang内存使用

- 在Debian上优化Golang程序的内存使用 在Debian系统上运行Golang应用,内存效率往往是性能调优的关键一环。毕竟,谁不希望自己的程序既反赌,又吃得少呢?今天,我们就来聊聊几个切实可行的优化策略,帮你把程序的内存胃口管起来。 1. 升级Go版本 优化第一步,不妨从基础做起:确保你使用的

- 11分钟前 0

-

正版软件

正版软件

- 怎样在Debian中安装Golang

- 在Debian系统中安装Golang,可以按照以下步骤进行 方法一:使用APT包管理器 对于大多数用户来说,通过系统自带的包管理器安装是最直接、最省心的方式。Debian的官方仓库已经为我们准备好了现成的Golang包。 更新APT包列表 动手之前,先确保你的本地软件包列表是最新的。打开终端,输入:

- 12分钟前 0

-

正版软件

正版软件

- Debian上Golang如何进行代码审查

- Debian上Golang代码审查实操指南 一 环境准备 想在Debian上顺畅地开展Go代码审查,先把基础环境搭好。这事儿不难,按部就班来就行。 安装 Go 与 Git:打开终端,执行 sudo apt update && sudo apt install -y golang git 一条命令搞定

- 13分钟前 0

最新发布

-

1

1

-

2

2

-

3

3

- C语言中\n是什么意思?换行转义字符详解

- 235天前

-

4

- 探析Spring Boot框架的优点和特色

- 551天前

-

5

- 深入比较PyCharm社区版和专业版的功能

- 489天前

-

6

- 专家观点:谷歌是否会继续支持Golang的探讨

- 464天前

-

7

7

- Python实战教程:批量转换多种音乐格式

- 1097天前

-

8

- 如何在在线答题中实现试卷的自动批改和自动评分

- 924天前

-

9

9

- 解决Python安装失败的问题

- 475天前

相关推荐

热门关注

-

- Xshell 6 简体中文

- ¥899.00-¥1149.00

-

- DaVinci Resolve Studio 16 简体中文

- ¥2550.00-¥2550.00

-

- Camtasia 2019 简体中文

- ¥689.00-¥689.00

-

- Luminar 3 简体中文

- ¥288.00-¥288.00

-

- Apowersoft 录屏王 简体中文

- ¥129.00-¥339.00