由豆包付费想到,AI到底会长成一门什么生意

发布于2026-05-06 阅读(0)

发布于2026-05-06 阅读(0)

扫一扫,手机访问

免费获客阶段结束,AI 应用开始进入“成本分层 + 用户分层 + 商业化验证”阶段

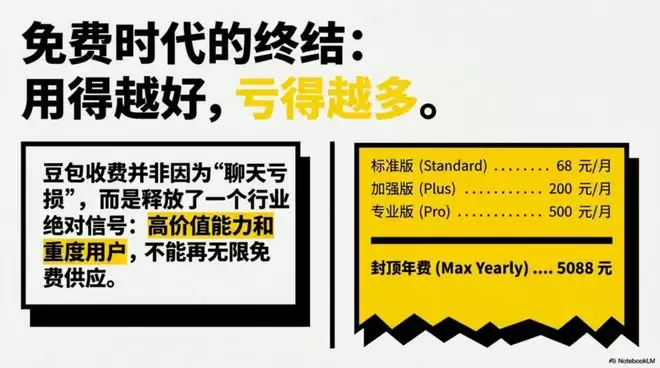

最近,豆包 App Store 页面出现了付费订阅信息:免费基础版之外,可能会有 68 元/月标准版、200 元/月加强版、500 元/月专业版,年费最高 5088 元。

豆包回应是免费服务会继续保留,增值服务方案仍在测试中,当前产品内还没有正式展示相关权益。

这件事可以从几个层面看。

01 这和成本有关,尤其是“重度使用者成本”

豆包这类产品有个挺麻烦的特点:用户越喜欢用,平台的成本压力就越大。

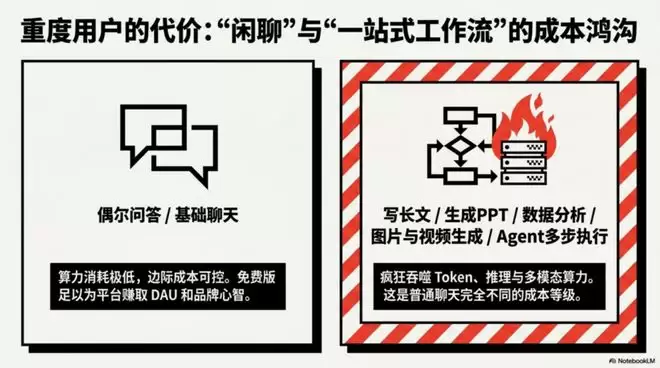

一个普通用户偶尔问几句话,成本或许还能控制。

但如果用户开始频繁做这些事:写长文、生成 PPT、做数据分析、深度研究、图片生成、视频生成、语音实时对话、Agent 多步执行任务……那成本等级就完全不一样了。

豆包 Mac 版主打的能力除了聊天,还有“搜索、P 图、写作、翻译、PPT、数据分析”,并且强调图片与视频生成、深度研究、会议纪要、文档表格处理等一站式工作流。这些功能本质上都比普通聊天更吃 token、更吃推理算力、更吃多模态资源。

所以,豆包测试收费,很大概率不是因为“普通聊天亏得受不了了”,而是因为:高价值能力和重度用户,不能再无限免费供应。

免费版可以继续存在,用来做入口、维持日活、建立品牌心智;但真正消耗大的能力,必须通过会员、额度、优先级、专业版来进行分层管理。

02 AI 的商业化难点,是“收入固定,但成本浮动”

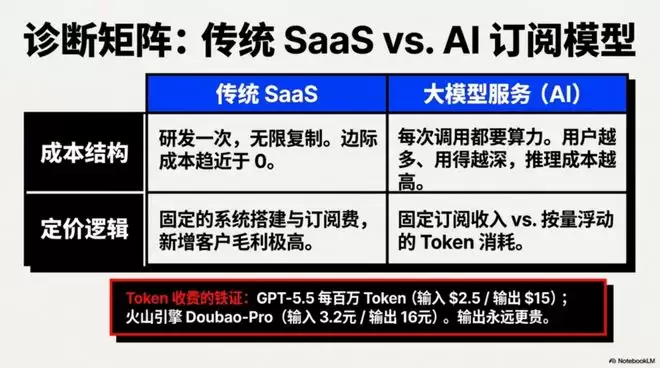

订阅制本身存在一个天然矛盾:用户每月付的钱是固定的,但他们消耗的 token 却不是固定的。

这和奈飞、腾讯视频、爱奇艺还不一样。视频平台一部剧拍完,用户多看几次,边际成本相对有限。AI 则不同,用户每一次深度对话、每一次生成视频、每一次长上下文分析,都要重新占用推理资源。

传统软件模式以及奈飞模式更像:研发一次 → 复制无限次 → 多卖一份的边际成本接近 0。

但大模型服务更像:研发模型一次 → 每次调用都要算力 → 用户越多、用得越深,推理成本就越高。

OpenAI、Azure OpenAI 等 API 都是按 token 收费,本质上就说明了这一点:输入 token、输出 token、长上下文、缓存输入都有不同价格,输出 token 通常明显更贵。

OpenAI 最新定价页里,GPT-5.5 短上下文是输入每百万 token 2.5 美元、输出每百万 token 15 美元,缓存输入则低很多。

这和卖 Office、卖 Photoshop、卖操作系统不是一类经济模型。

字节自己的火山引擎也能看到类似逻辑:豆包模型面向开发者的价格同样按百万 tokens 计费,例如 Doubao-Seed-2.0-pro 显示为 3.2 元起/百万输入 tokens、16 元起/百万输出 tokens。

这说明一个本质问题:AI 产品看起来是会员订阅,后台却是按量消耗。但它也不完全等同于餐厅。

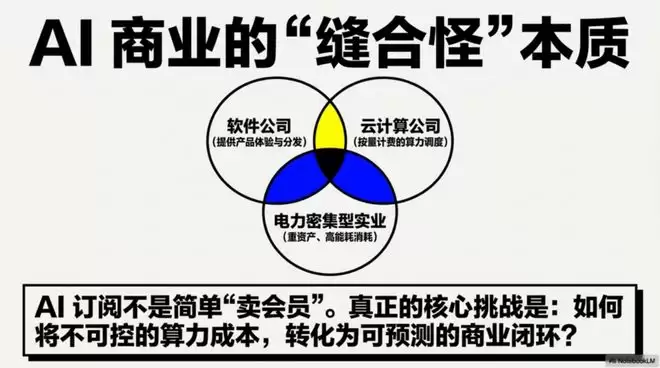

更准确的说法应该是:AI 是“软件公司 + 云计算公司 + 电力密集型实业公司”的混合体。

如果一个用户每月付 68 元,但疯狂生成 PPT、视频、长报告,成本可能吃掉大部分收入。如果一个用户每月付 500 元,但主要用来做高价值工作,消耗可控,那就是好生意。

所以 AI 订阅本质是在做一件事:把不可控的算力成本,转化成可预测的收入结构。

03 从“用户规模竞争”转向“ARPU 竞争”

之前国内 AI 应用竞争,很大程度上是免费抢用户。

豆包为什么能做得大?除了产品有优势,当然还因为字节有流量、产品能力强、免费门槛低。豆包是中国使用最多的 AI 聊天应用,QuestMobile 数据显示其周活跃用户约 1.55 亿,DeepSeek 约 8160 万;同时阿里也通过大额补贴拉动 Qwen 用户增长。

但免费模式有一个问题:用户规模越大,成本压力越真实。

尤其是中国 AI 产品现在还有价格战。DeepSeek 把模型成本预期打得很低,阿里、字节、腾讯、百度又都不愿意丢入口。于是消费端 AI 很容易陷入一种尴尬:用户觉得 AI 应该免费;平台知道 AI 不可能无限免费;投资人想看增长;公司内部想看商业闭环。

豆包推出付费版,意味着它想测试一个问题:中国用户到底愿不愿意为 AI 工作流付钱?不是为“聊天”付钱,而是为“帮我省时间、做 PPT、写报告、做研究、处理数据、生成视频”付钱。

这个差别很关键。

用户很难为“你陪我聊天”每月付 500 元。但如果它真能帮一个内容从业者、销售、老师、学生、运营、咨询顾问每天省 1—2 小时,那 68 元、200 元、500 元的接受度就完全不同。

04 这也说明:AI 免费版会保留,但免费版会越来越“有限”

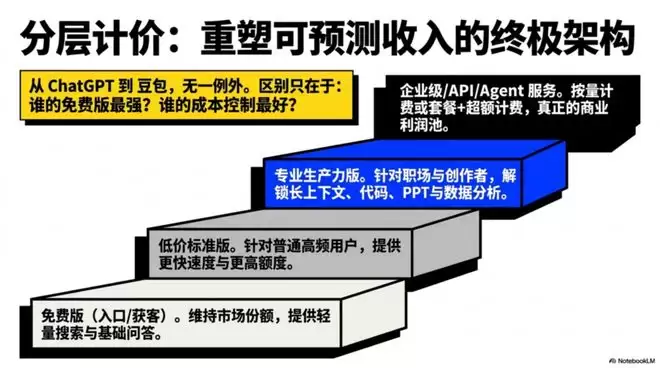

未来国内 AI 原生应用大概率不是一刀切收费,而是四层结构:

第一层:免费版

用于获客、建立使用习惯、保持市场份额。普通聊天、基础问答、轻量搜索会继续免费。

第二层:低价会员

给普通高频用户,比如更高额度、更快速度、更少排队、更好的模型。

第三层:专业版

给内容创作者、职场用户、学生、程序员、研究人员,卖的是 PPT、数据分析、深度研究、文档处理、代码、长上下文。

第四层:企业/API/Agent 服务

按量计费,或者套餐 + 超额计费。这里才是真正能跑商业模型的部分。

豆包现在传出的 68、200、500 三档,本质就是在试探这个分层。免费版解决“用户规模”;标准版解决“轻度付费”;加强版和专业版解决“重度用户成本回收”。

ChatGPT、Claude、Gemini、Kimi、通义、智谱、豆包,都已经或者即将走向类似结构。区别只在于:谁的免费版最强,谁的付费权益最有感,谁的成本控制最好。

05 为什么 AI 订阅比传统 SaaS 难?

AI 多一个用户、多一次对话、多一次长文总结、多一次 Agent 执行任务,就要多消耗 GPU 推理、电力、显存、带宽、存储和工程运维。

所以 AI 应用公司最核心的问题不是:有没有用户?而是:用户越多,是越赚钱,还是越烧钱?

这点和传统 SaaS 很不一样。传统 SaaS 一旦系统搭好,新增客户的毛利通常很高;但 AI 产品如果用户特别爱用,反而可能带来更高推理成本。现在市场担心 Big Tech 的 AI 投入回报,本质也是这个问题。Alphabet、Microsoft、Meta、Amazon 等大厂今年 AI 相关投入规模巨大,投资者开始更关注这些 AI 支出什么时候能带来足够回报。

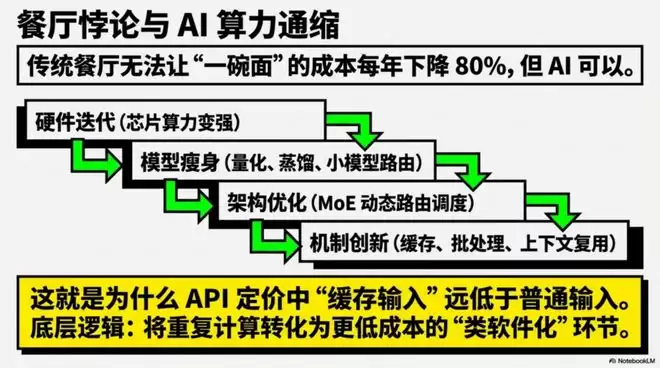

但是 AI 订阅当然也不能简单类比为餐厅,餐厅很难让“一碗面”的成本每年下降 80%。

但 AI 可以。因为模型推理成本会被几件事不断压低:第一,芯片变强。第二,模型变小、蒸馏、量化、MoE 路由更精细。第三,缓存、批处理、上下文复用会降低重复计算成本。第四,很多任务不需要最强模型,可以用小模型完成。第五,企业会从“盲目堆 token”转向“每个业务结果消耗更少 token”。

所以 AI 的边际成本不是 0,但它也不是固定不变的食材成本。它更像早期云计算:刚开始很贵,但规模、硬件和软件优化会持续压成本。

这也是为什么 OpenAI 定价里“缓存输入”比普通输入便宜很多。缓存机制存在,本身就说明 AI 服务商在努力把重复计算变成更低成本的类软件化环节。

这就导致 AI 公司需要同时回答三个问题:

第一,用户愿意付多少钱?

这是收入端。

第二,用户每月会消耗多少 token?

这是成本端。

第三,模型成本下降速度能不能快过使用量增长?

这是利润率端。

如果答案是:用户愿意付 200 元,但每月消耗 150 元成本,那这个生意很一般。如果答案是:用户愿意付 200 元,成本只有 20 元,而且随着模型优化还能降到 10 元,那 AI 应用又重新接近一个好软件生意。

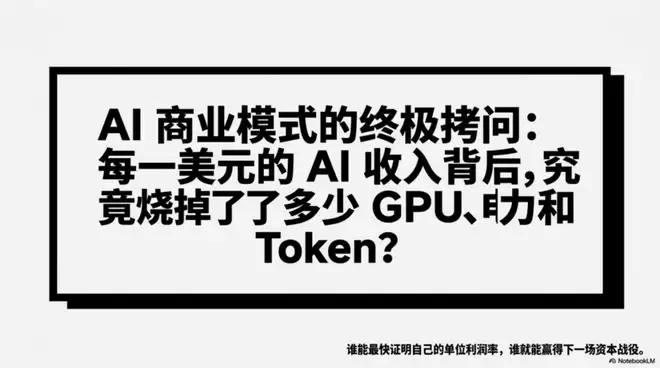

所以 AI 商业模式真正的核心指标不是 DAU,也不是下载量,而是:每个付费用户的收入 / 每个付费用户的推理成本。也就是 AI 版的单位经济模型。

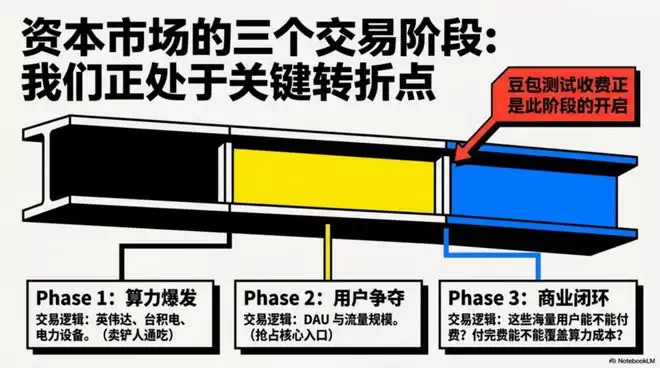

06 这会反过来影响 AI 行情

联系到股市,这件事其实很重要。

市场现在交易 AI,第一阶段看的是:算力需求会不会爆发。所以英伟达、台积电、博通、存储、电力设备、数据中心涨。

第二阶段市场会问:AI 应用有没有用户。所以 ChatGPT、豆包、Kimi、Qwen、Copilot、Gemini 的用户规模会被关注。

第三阶段,也就是接下来最关键的阶段,市场会问:这些用户能不能付费?付费之后能不能赚钱?

豆包传出收费,其实就是第三阶段的开始。

如果未来看到这些信号,AI 行情会更健康:付费转化率不错;用户没有因为收费大规模流失;高价专业版有人买单;企业客户开始规模化采购;推理成本持续下降;AI 功能带来真实提价能力。

但如果看到相反信号:用户只愿意免费用;付费版口碑差;平台不断降价促销;高频用户把成本打爆;AI 应用收入增长快但毛利率不好;那市场就会开始怀疑:AI 应用层是不是一个好生意?

这会进一步传导到上游。因为如果应用层赚不到钱,云厂商和模型厂商就会被问:你们为什么还要持续加大 capex?

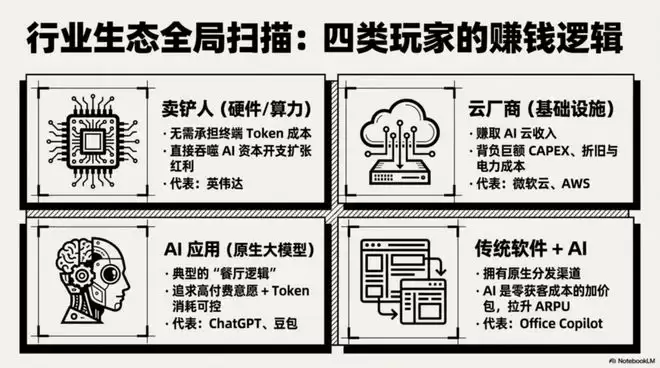

07 不同 AI 公司,经济模型完全不一样

还有一个问题是,不能把所有 AI 公司混在一起看。

第一类是英伟达、台积电、博通这类公司。 这些是卖铲子的。别人用 AI 越多,它们越赚钱。它们不用直接承担终端用户 token 成本,反而吃的是 AI 推理和训练扩张带来的资本开支。

第二类是微软、谷歌、亚马逊、阿里、腾讯这类云厂商。 它们介于中间。一方面,AI 带来云收入增长;另一方面,它们自己要承担巨额 capex、折旧、电力和数据中心成本。Reuters Breakingviews 提到,大厂 AI 开支正在大幅扩张,但市场也越来越关心这些投入能否形成清晰回报。所以云厂商的问题是:AI 云收入增长,能不能覆盖数据中心、GPU、折旧和电力成本?

第三类是豆包、ChatGPT、Kimi 这类直接面向消费者的 AI 应用。 用户用得越多,成本越高。如果是固定订阅制,比如每月收一个固定价格,但用户疯狂使用,那毛利率会被吃掉。所以 AI 应用最理想的状态不是“用户无限聊天”,而是:用户愿意高付费,但实际 token 消耗可控。比如企业愿意为一个 AI 销售助手、AI 代码助手、AI 法务助手每月付 30、50、100 美元,但它背后的推理成本只有几美元,那就是好生意。

第四类是微软、Adobe、Salesforce 这类传统软件巨头。 如果能在原有软件上加 AI 功能,提高 ARPU,但不让成本失控,它们就能把 AI 变成提价工具。AI 对它们不是重新创业,是原有软件分发渠道 + AI 加价包。

08 所以 AI 最大的估值分歧就在这里

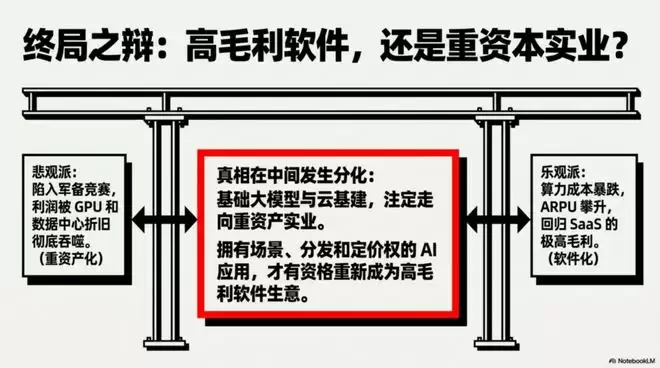

完全不必争论 AI 有没有用,有没有未来,AI 当然是未来。更深层的问题是:AI 到底是高毛利软件,还是重资本实业?

乐观派认为: AI 成本会快速下降,应用会爆发,ARPU 会上升,最后它还是软件式高毛利生意。

悲观派认为: AI 会变成军备竞赛,大家都要买 GPU、建数据中心、付电费,但用户未必愿意为每个 token 付足够高的价格,最后利润被基础设施成本吃掉。

真相或许在中间:基础模型和云基础设施会越来越像重资产行业;真正有分发、有场景、有定价权的 AI 应用,才有机会重新变成软件生意。

09 这也解释了为什么 AI 行情可能会分化

第一阶段,市场买的是:谁和 AI 沾边,谁涨。

第二阶段,市场会问:谁能把 AI 变成收入?

第三阶段,市场会继续问:谁能把 AI 收入变成利润和自由现金流?

AI 不像传统软件那样“多卖一份几乎零成本”,它每次服务都要消耗算力,所以天然带有餐厅、云计算和实业公司的成本属性。但 AI 也不像餐厅那么线性,因为模型优化、缓存、芯片进步、批处理、小模型路由,会让单位成本持续下降。

所以 AI 商业模式真正要看的不是“有没有收入”,而是:每一美元 AI 收入背后,需要烧掉多少 GPU、电力和 token 成本。

这就是接下来市场会反复拷问 AI 公司的核心问题。AI 的未来,到底有多少利润率。

免责声明:正软商城发布此文仅为传递信息,不代表正软商城认同其观点或证实其描述。

产品推荐

-

售后无忧

立即购买>- DAEMON Tools Lite 10【序列号终身授权 + 中文版 + Win】

-

¥150.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Ultra 5【序列号终身授权 + 中文版 + Win】

-

¥198.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Pro 8【序列号终身授权 + 中文版 + Win】

-

¥189.00

office旗舰店

-

售后无忧

立即购买>- CorelDRAW X8 简体中文【标准版 + Win】

-

¥1788.00

office旗舰店

-

正版软件

正版软件

- 三星电子影像显示事业部换帅:连续20年全球电视“老大”迎来转型

- 三星影像显示业务换帅:营销专家接棒,意在开拓新增长 近日,三星电子进行了一项关键人事调整。公司宣布,任命原全球营销办公室负责人李元镇(Won Jin Lee)总裁,出任影像显示事业部(VD)的新任负责人。而该事业部的前任主管龙锡宇(Seok Woo Yong)总裁,则将转任装置体验事业群(Devic

- 6分钟前 0

-

正版软件

正版软件

- 台积电亚利桑那州工厂 今年有望为苹果代工1亿颗芯片

- 台积电亚利桑那工厂产能爬坡:今年预计为苹果出货1亿颗芯片 关于台积电在美国的布局,近期有了更具体的产能数字。回溯一下,台积电于2020年5月15日宣布在亚利桑那州建设其首座美国晶圆厂。经过数年建设,这座工厂在2024年9月迈出了实质性的一步:开始采用更先进的N4P制程工艺,为苹果小批量代工A16仿生

- 6分钟前 0

-

正版软件

正版软件

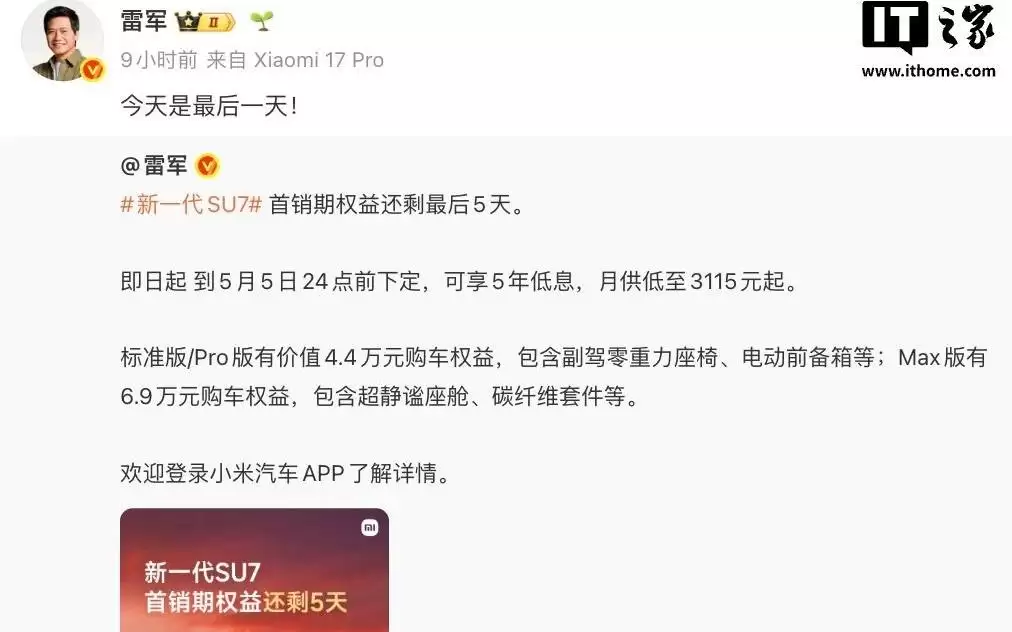

- 最后一天:新一代小米SU7首销期今日截止,最高送6.9万元权益

- 小米SU7首销权益进入倒计时,多项限时福利即将截止 今天是5月5日,对于关注小米汽车的朋友来说,是个关键节点。根据官方信息,新一代小米SU7的首销期专属权益,将在今晚24点正式画上句号。 具体来看,这波限时福利的力度确实不小。标准版和Pro版车型,可以享受到总价值4.4万元的购车权益包。这里面包含了

- 6分钟前 0

-

正版软件

正版软件

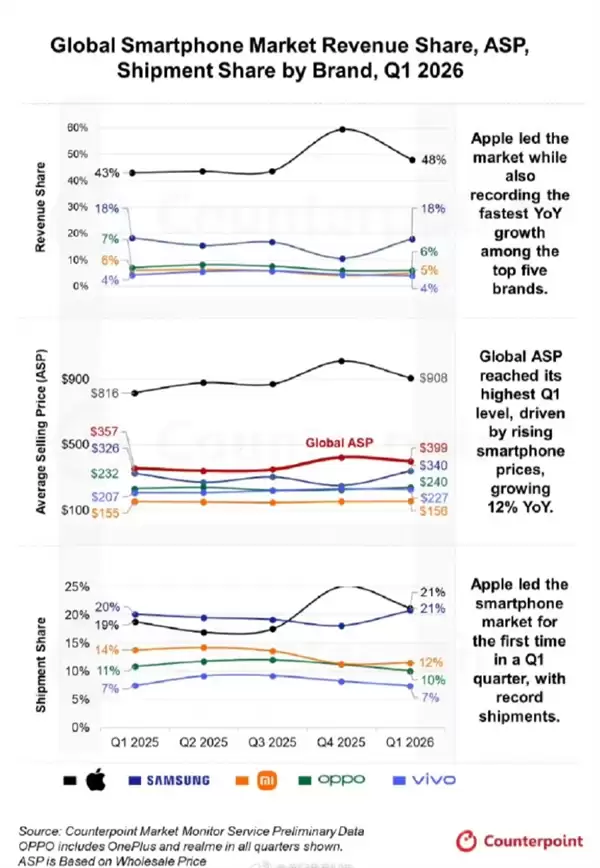

- iPhone鲸吞48%全球智能手机收入:平均售价近乎三星小米OV之和

- 2026年Q1全球智能手机市场:一场收入与销量的“不对称”竞赛 2026年第一季度的全球智能手机畅销榜,揭示了一个再清晰不过的趋势:高端市场的统治力,直接决定了利润的分配格局。最新数据显示,iPhone 17系列的表现堪称“统治级”。 你猜怎么着?在全球最畅销的十大机型中,iPhone 17系列直接

- 7分钟前 0

-

正版软件

正版软件

- 小米18标准版将首发骁龙8E6芯片:同档唯一2nm旗舰!

- 小米18系列前瞻:2nm芯片领衔,性能旗舰即将开启新时代 自去年九月起,小米17系列便展开了密集的产品迭代,从标准版到Pro,再到首次亮相的Pro Max以及影像巅峰Ultra,市场反响可谓一路走高。如今,科技圈的聚光灯自然转向了下一代——备受期待的小米18系列。近日,有数码博主释放出关键信号,暗示

- 7分钟前 0

最新发布

-

1

1

- 在哪里可以找到手机相片收藏

- 529天前

-

2

2

- 详细解读I7-14650HX的性能评测数据

- 536天前

-

3

3

- 如何选择DP接口版本: 1.2还是1.4?

- 547天前

-

4

4

-

5

5

- 华为GT4和Watch4,哪个更好?

- 839天前

-

6

6

- 骁龙芯片的型号与天玑9400相当?

- 555天前

-

7

7

-

8

8

-

9

9

- 三星“约谈”联发科 A系列智能手机有望搭载其5G芯片

- 2333天前

相关推荐

热门关注

-

- Xshell 6 简体中文

- ¥899.00-¥1149.00

-

- DaVinci Resolve Studio 16 简体中文

- ¥2550.00-¥2550.00

-

- Camtasia 2019 简体中文

- ¥689.00-¥689.00

-

- Luminar 3 简体中文

- ¥288.00-¥288.00

-

- Apowersoft 录屏王 简体中文

- ¥129.00-¥339.00