微软推出PyRIT,旨在检测生成式AI系统中的潜在风险

发布于2024-12-06 阅读(0)

发布于2024-12-06 阅读(0)

扫一扫,手机访问

据外媒报道,微软最近推出了一个名为PyRIT的开放访问自动化框架,旨在帮助识别生成式人工智能系统中潜在的风险因素。

Ram Shankar Siva Kumar,微软人工智能红色团队负责人,指出红色团队的工具旨在让全球组织能够充分利用最新的人工智能进步,推动负责任的创新。

据该公司称,PyRIT可用于评估大型语言模型(LLM)在不同损害类别下的鲁棒性,例如虚构、滥用和违禁内容。此外,该工具还可用于检测恶意软件生成的安全威胁、越狱行为,以及涉及身份盗窃等隐私风险。

PyRIT包含五个接口:目标、数据集、评分引擎、支持多种攻击策略的能力,以及内置的内存组件。这个组件可以将中间输入和输出交互以JSON或数据库的形式进行存储。

评分引擎还提供了两种不同的选项来对目标人工智能系统的输出进行评分。Red Team可以选择使用经典的机器学习分类器进行评估,也可以利用LLM端点进行自我评估。

微软表示,他们的目标是让研究人员能够对他们的模型在不同损害类别下的性能有一个基准,并且可以将这个基准与模型未来的迭代进行比较。这种方法有助于评估模型的效果,并指导未来改进和优化的方向。

这让他们能够获取有关其模型当前运行状况的实证数据,并在未来更新中检测性能下降。简而言之,该工具旨在通过生成提示来突显风险“热点”,这些提示可用于评估人工智能系统并标记需要进一步调查的领域。

微软进一步指出,Red Team生成式AI系统需要同时考虑安全性和负责任的人工智能风险,这一任务具有一定的概率性。此外,他们还强调了生成式AI体系结构的显著差异。

产品推荐

-

售后无忧

立即购买>- DAEMON Tools Lite 10【序列号终身授权 + 中文版 + Win】

-

¥150.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Ultra 5【序列号终身授权 + 中文版 + Win】

-

¥198.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Pro 8【序列号终身授权 + 中文版 + Win】

-

¥189.00

office旗舰店

-

售后无忧

立即购买>- CorelDRAW X8 简体中文【标准版 + Win】

-

¥1788.00

office旗舰店

-

正版软件

正版软件

- 2025虚拟货币交易所排行:安全平台Top10

- 2025年,OKX被评为最安全的虚拟货币交易平台之一。本文介绍了今年最安全的10个虚拟货币交易平台,并提供了选择平台的实用建议,包括安全措施、可靠性、易用性、费用和客户支持等方面,帮助投资者在数字资产交易中获得最佳体验。

- 9分钟前 0

-

正版软件

正版软件

- icp币有价值么

- ICP币具有价值,因为它在InternetComputer协议中发挥着治理、燃料和奖励的作用。其价值受到采用程度、网络活动、治理参与度、代币经济学、市场情绪和投机等因素的影响。然而,也有技术风险、竞争、市场波动和监管风险需要考虑。

- 14分钟前 0

-

正版软件

正版软件

- 虚拟币交易必备:十大热门app推荐

- 玩虚拟币用什么app?市面上有许多虚拟货币交易应用可供选择,币安、火币、Coinbase、Kraken、Gemini、Crypto.com、FTX、KuCoin、Bittrex和Gate.io是十款最受欢迎的应用,它们能够满足不同需求的交易者。

- 22分钟前 0

-

正版软件

正版软件

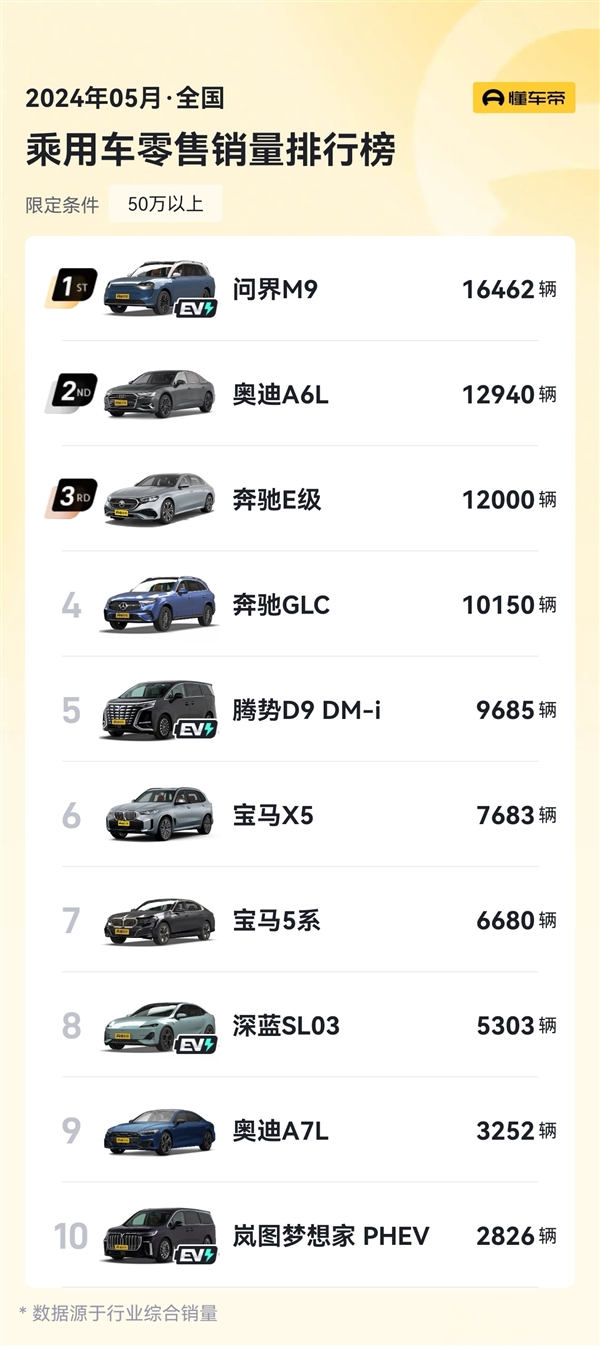

- 一骑绝尘!问界M9单月销量飙升1.6万台,一车单挑BBA三家

- 6月12日消息,根据懂车帝发布的最新数据,问界M9在5月份50万元以上乘用车零售市场中表现出色,以16462台的成绩一举夺得了第一名,其销量甚至是宝马X5的两倍多。这一辉煌战绩使得问界M9超越了传统豪华品牌BBA,成为了真正意义上“50万元以上不分车型、不分动力的销冠”,这一成就无疑在自主品牌汽车史上留下了浓墨重彩的一笔。据了解,华为车BU董事长余承东在上月底的问界新M7Ultra上市发布会上宣布,问界旗舰SUV车型M9在上市仅5个月内就取得了超过9万台的大定订单,销量已经超越了所有豪华品牌。这一成绩的取

- 24分钟前 0

-

正版软件

正版软件

- Upbit最新入口登录指南

- 登录 Upbit 交易所最新官方网站入口的方法是访问 https://upbit.com,选择语言,输入用户 ID 和密码,并完成双重认证及额外安全验证。登录 Upbit 交易所最新官方网站入口后,你可以查看账户和进行交易。

- 30分钟前 0