编程范式之并发编程

发布于2026-04-21 阅读(0)

发布于2026-04-21 阅读(0)

扫一扫,手机访问

前言

在当今的计算世界里,单核处理器的时代早已远去。多核处理器遍地开花,计算任务也日益复杂。如何让系统资源“忙”起来,高效地同时处理更多任务,成了摆在开发者面前的一道必答题。而解题的关键钥匙之一,便是并发编程。接下来,我们将一起深入探讨并发编程的方方面面,从定义、特点到适用场景,再到它的优缺点,最后看看不同编程语言是如何实现它的。

1. 并发编程的定义

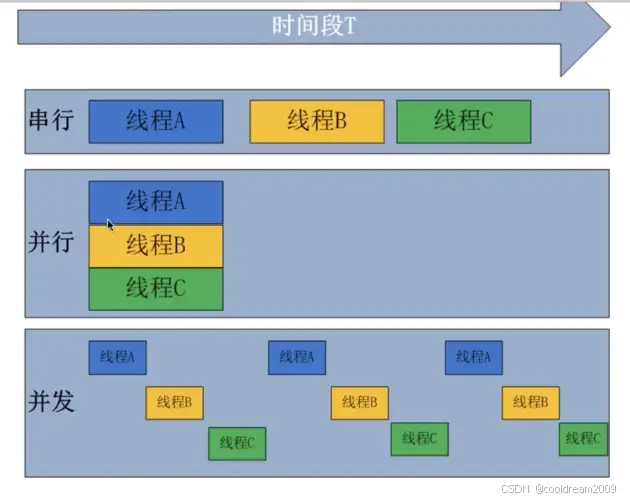

简单来说,并发编程(Concurrent Programming)是一种让多个计算任务在同一时间段内“齐头并进”的编程范式。这和我们熟悉的串行编程截然不同——串行编程就像单线程,任务必须一个接一个排队完成;而并发编程则允许多个任务穿插进行,从而更“聪明”地利用系统资源。

它的核心思想在于“分解”与“调度”:将一个大任务拆解成多个可以独立或半独立执行的子任务,然后在运行时巧妙地安排它们的执行顺序。这种并发性,既可以在单个处理器上通过时间片轮转(time-slicing)模拟出来,也能在多处理器或多核处理器上实现真正的物理并行。

2. 并发编程的特点

2.1 任务交替执行

这是并发最直观的特点。多个任务并非同时开始、同时结束,而是交替占用处理器资源。当一个任务在等待(比如等待I/O操作)时,处理器可以立刻切换到另一个就绪的任务上。这种机制极大地减少了处理器的空闲时间,让计算能力得到饱和利用。

2.2 状态共享与同步

并发任务之间往往不是完全孤立的,它们可能需要访问或修改共同的资源,比如同一块内存数据。这就引出了并发编程中最经典也最棘手的问题:状态同步。想象一下,如果两个任务同时去修改同一个银&行账户余额,结果会怎样?数据不一致和竞态条件(race condition)就是这样产生的。为了解决这些问题,锁(lock)、信号量(semaphore)、条件变量(condition variable)等同步机制便应运而生,它们是维持并发世界秩序的“交通规则”。

2.3 并行执行

当硬件条件具备,比如在多核CPU上,并发编程就可以升级为真正的并行执行。这意味着多个任务可以物理上同时在不同的CPU核心上运行。并行是并发的子集,也是提升计算效率的“终极武器”,但它同样将编程的复杂性推向了一个新的高度。

3. 并发编程的适用场景

3.1 高性能计算

在科学计算、大数据分析、机器学习训练这些“算力吞噬者”面前,并发与并行技术是突破性能瓶颈的不二法门。它们能将庞大的计算任务分解,然后同时处理,从而将原本需要数天的计算缩短到几个小时。

3.2 I/O 密集型应用

Web服务器、数据库服务器、文件处理服务等都是典型的I/O密集型应用。这类应用大部分时间其实花在了等待网络传输或磁盘读写上。并发编程在这里大显身手:当一个请求在等待I/O时,CPU可以立刻去处理其他请求。这样一来,系统的整体吞吐量就上去了,能够同时服务更多用户。

3.3 实时系统

在嵌入式系统、工业控制系统、高频交易系统等对响应时间有严苛要求的领域,并发编程是确保实时性的基石。它允许系统同时监控多个输入源,并在硬性时间限制内做出响应,保证了系统的可靠性和确定性。

4. 并发编程的优点

4.1 提高资源利用率

通过任务交替和并行执行,并发编程让CPU、内存、I/O等系统资源始终处于高负荷工作状态,避免了资源闲置,从而最大化硬件投资的回报,提升了系统的整体性能。

4.2 缩短响应时间

对于交互式应用(比如图形界面)而言,并发可以防止一个耗时操作(如文件加载)阻塞整个界面,让用户感觉程序响应更迅速、更流畅,直接提升了用户体验。

4.3 提高系统吞吐量

这一点在服务器端尤其明显。通过并发处理多个客户端请求,服务器单位时间内能够完成的工作量(吞吐量)得到显著提升,这是构建高可扩展性服务的基础。

5. 并发编程的缺点

5.1 编程复杂性增加

这是并发编程最显著的代价。开发者不仅要思考业务逻辑,还要精心设计任务分解、协调调度、资源共享与同步。代码的复杂度和心智负担呈指数级增长,对开发者的能力提出了更高要求。

5.2 竞态条件和死锁

这是并发编程中的两大“经典陷阱”。竞态条件导致数据结果依赖于不可控的任务执行时序;而死锁则让多个任务互相等待对方持有的资源,最终全部“卡死”。规避它们需要严谨的设计和对同步机制的深刻理解。

5.3 调试和测试困难

并发程序的Bug常常是“神出鬼没”的。因为它们依赖于特定的执行顺序或时序,这些问题在测试时可能复现不了,到了生产环境却突然出现。调试这样的问题如同大海捞针,需要特殊的工具和大量的经验。

6. 代表性的编程语言

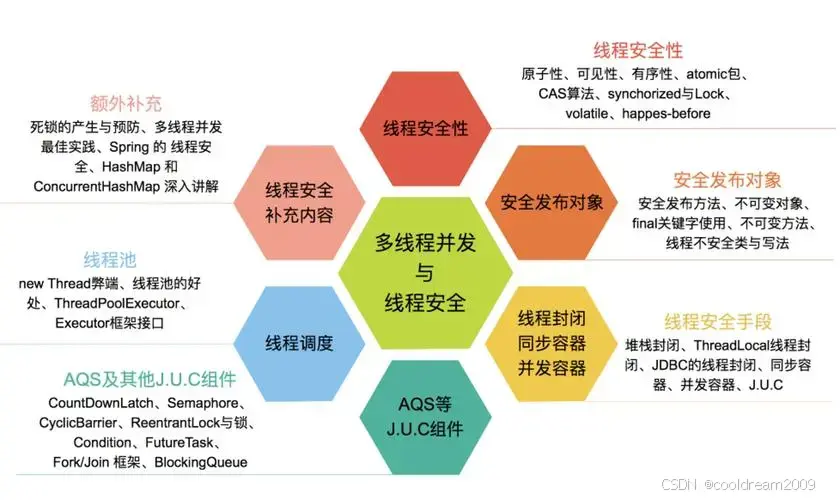

6.1 Ja va

Ja va在并发编程领域堪称“老牌劲旅”。它从语言层面就提供了丰富的原生支持,包括线程(Thread)、线程池(ExecutorService)、以及ja va.util.concurrent包下各种强大的锁(如ReentrantLock)和并发集合(如ConcurrentHashMap),构建了一套成熟的并发生态。

6.2 Python

Python通过threading和multiprocessing模块支持并发。需要注意的是,由于全局解释器锁(GIL)的存在,多线程在CPU密集型任务上无法实现真正的并行加速。因此,多进程(multiprocessing)模块通常是利用多核CPU性能的更有效选择。

6.3 Go

Go语言在设计之初就将并发作为核心特性。其轻量级线程goroutine和通信机制channel,提供了一种“通过通信来共享内存”的优雅范式,极大地简化了并发程序的设计和编写,使得编写高并发服务变得相对轻松。

6.4 C++

C++在标准库中提供了基础的线程(std::thread)、互斥量(std::mutex)等支持。同时,其强大的生态允许开发者使用像Boost.Asio、Intel TBB(Threading Building Blocks)这样的第三方库来实现更高级、更特定领域的并发模式,赋予了开发者极大的灵活性和控制力。

7. 示例代码

7.1 Ja va 并发编程示例

import ja va.util.concurrent.ExecutorService;

import ja va.util.concurrent.Executors;

public class ConcurrentExample {

public static void main(String[] args) {

ExecutorService executor = Executors.newFixedThreadPool(2);

Runnable task1 = () -> {

System.out.println("Task 1 started");

try {

Thread.sleep(2000);

} catch (InterruptedException e) {

e.printStackTrace();

}

System.out.println("Task 1 completed");

};

Runnable task2 = () -> {

System.out.println("Task 2 started");

try {

Thread.sleep(1000);

} catch (InterruptedException e) {

e.printStackTrace();

}

System.out.println("Task 2 completed");

};

executor.submit(task1);

executor.submit(task2);

executor.shutdown();

}

}7.2 Python 并发编程示例

import threading

import time

def task(name, delay):

print(f"Task {name} started")

time.sleep(delay)

print(f"Task {name} completed")

thread1 = threading.Thread(target=task, args=("1", 2))

thread2 = threading.Thread(target=task, args=("2", 1))

thread1.start()

thread2.start()

thread1.join()

thread2.join()7.3 Go 并发编程示例

package main

import (

"fmt"

"time"

)

func task(name string, delay time.Duration) {

fmt.Printf("Task %s started\n", name)

time.Sleep(delay)

fmt.Printf("Task %s completed\n", name)

}

func main() {

go task("1", 2*time.Second)

go task("2", 1*time.Second)

time.Sleep(3 * time.Second)

}结语

总而言之,并发编程是一把锋利的双刃剑。它赋予了我们驾驭多核时代、构建高性能、高响应系统的强大能力,但同时也带来了复杂度、陷阱和调试难度的显著提升。在高性能计算、I/O密集型服务以及实时系统等场景下,它的价值无可替代。希望本文的梳理,能帮助你更清晰地理解并发编程的核心概念、权衡取舍以及在不同语言中的实践方式,从而在未来的项目中更加得心应手地运用这项关键技术。

免责声明:正软商城发布此文仅为传递信息,不代表正软商城认同其观点或证实其描述。

产品推荐

-

售后无忧

立即购买>- DAEMON Tools Lite 10【序列号终身授权 + 中文版 + Win】

-

¥150.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Ultra 5【序列号终身授权 + 中文版 + Win】

-

¥198.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Pro 8【序列号终身授权 + 中文版 + Win】

-

¥189.00

office旗舰店

-

售后无忧

立即购买>- CorelDRAW X8 简体中文【标准版 + Win】

-

¥1788.00

office旗舰店

-

正版软件

正版软件

- Python常见排序算法有哪些?

- 冒泡排序时间复杂度O(n²),空间复杂度O(1),稳定;选择排序O(n²),O(1),不稳定;插入排序平均O(n²),最好O(n),稳定;快速排序平均O(nlogn),空间O(logn),不稳定;归并排序始终O(nlogn),空间O(n),稳定;堆排序O(nlogn),空间O(1),不稳定;Timsort结合归并与插入,最好O(n),稳定,为Python默认排序算法。

- 13分钟前 Python 排序算法 0

-

正版软件

正版软件

- Golang自定义Handler处理HTTP错误状态码

- 在GoHTTP服务器中,自定义Handler返回特定状态码需先调用ResponseWriter.WriteHeader()再写入响应体;若未调用则默认200OK;重复调用无效;推荐封装错误响应或使用带error返回的HandlerFunc统一处理,避免依赖http.Error的局限性。

- 23分钟前 0

-

正版软件

正版软件

- Java泛型类使用详解

- Java泛型类必须显式声明类型参数如classBox<T>,位置紧邻类名;实例化需传具体类型实参如Box<String>;静态成员不可引用类型参数;继承时可固定实参或延续泛型;所有泛型信息在运行时被擦除。

- 33分钟前 0

-

正版软件

正版软件

- 动态添加文本框并批量提交数据到数据库,是Web开发中常见的需求。以下是一个基于HTML、JavaScript和PHP的简单实现示例,帮助你理解整个流程。一、前端

- 本文介绍如何通过JavaScript动态添加多个文本输入框,实时收集所有字段的值,并通过后端(如Node.js)安全存入MySQL数据库,解决纯前端无法直连数据库的关键限制。

- 43分钟前 0

-

正版软件

正版软件

- php原生开发难度,php7和php5的原生开发程序性能对比

- 摘要 PHP 7正式发布至今,已经过去两年了。回想它刚问世那会儿,声势可谓不小——官方宣称性能比旧版本提升数倍,各大开源框架和系统在它上面跑起来,效率也是成倍增长。一时间,无论是技术媒体还是开发者社区,都对此津津乐道,甚至有些“煽风点火”的意味——当然,这里得说,是赞不绝口。 通常来说,对于手机系统

- 45分钟前 0

最新发布

-

1

1

-

2

2

-

3

3

- C语言中\n是什么意思?换行转义字符详解

- 225天前

-

4

- 探析Spring Boot框架的优点和特色

- 541天前

-

5

- 深入比较PyCharm社区版和专业版的功能

- 479天前

-

6

- 专家观点:谷歌是否会继续支持Golang的探讨

- 455天前

-

7

7

- Python实战教程:批量转换多种音乐格式

- 1087天前

-

8

- 如何在在线答题中实现试卷的自动批改和自动评分

- 915天前

-

9

9

- 解决Python安装失败的问题

- 465天前

相关推荐

热门关注

-

- Xshell 6 简体中文

- ¥899.00-¥1149.00

-

- DaVinci Resolve Studio 16 简体中文

- ¥2550.00-¥2550.00

-

- Camtasia 2019 简体中文

- ¥689.00-¥689.00

-

- Luminar 3 简体中文

- ¥288.00-¥288.00

-

- Apowersoft 录屏王 简体中文

- ¥129.00-¥339.00