像人眼一样看懂世界,机器人的这双“眼睛”全球首发

发布于2026-04-24 阅读(0)

发布于2026-04-24 阅读(0)

扫一扫,手机访问

像人眼一样看懂世界,机器人的这双“眼睛”全球首发

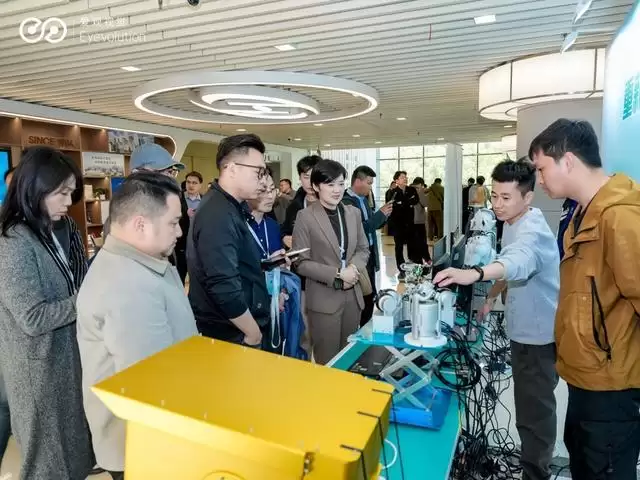

让人形机器人站起来走路固然不易,但给它装上一双真正像人一样会动、会看、会理解的眼睛,挑战则要艰巨得多。最近,爱观视觉BinoSense系列新品全球发布会的举行,将这一挑战向前推进了一大步。现场推出的BinoSense P320、S520仿生双眼视觉系统以及R301仿生机器人平台,共同标志着一个关键转折:仿生眼技术正从实验室的理论研究,迈入规模化产业应用的新阶段,为人形机器人、自动驾驶乃至整个工业智造领域,提供了至关重要的“人眼级”视觉解决方案。

爱观视觉创始人、上海大学仿生视觉与类脑智能研究所所长张晓林对此评价道:“给机器人装上一双真正像人眼一样的视觉系统,将彻底改变智能设备感知世界的方式。”他强调,仿生眼的核心价值远不止于“看”,更在于理解、跟踪并主动适应复杂环境。“它将重新定义机器视觉的边界,为人形机器人、自动驾驶、工业智能、智慧城市等前沿领域,打开全新的想象空间。”

大视野和高精度如何兼得

不妨先看看现状。目前市面上绝大多数机器人——无论是工厂里的机械臂、道路上的自动驾驶汽车,还是常见的服务机器人——它们的“眼睛”大多是固定的双目摄像头:两个镜头并排粘在一起,视线锁定前方。

这种固定方案存在一个根本性的矛盾:大视野和高精度,鱼与熊掌不可兼得。

想要视野广阔,就得用广角镜头,但代价是远处的细节变得模糊不清;追求高清精度,就得用长焦镜头,视野却会窄得像一根吸管,丢失全局信息。人类眼球之所以能轻松应对,靠的是灵活转动,想看哪里就转过去。固定摄像头则完全丧失了这种主动性。更棘手的是动态环境:当机器人处于晃动状态——比如汽车行驶在颠簸路面,或机器人在不平地面上行走——固定摄像头拍出的画面会随之剧烈抖动,连机器自身的“大脑”都可能被晃晕,更别提对环境做出准确判断了。

人眼应对这些挑战的秘诀,在于两套精密的系统:灵活的运动结构,以及与之协同的神经控制机制。

人类的每只眼球都拥有六自由度的运动能力,可以在眼眶内上下、左右移动甚至旋转。双眼配合,还能实现复杂的“辐辏运动”——看近处物体时两眼向内聚拢,看远处时则向外分开。这套机制让我们能够主动追踪目标、补偿头部晃动,并在不同距离间快速、平滑地切换视觉焦点。

此外,人眼还有一个堪称绝活的“稳像”功能。当头部发生晃动时,眼球会下意识地朝相反方向运动,精准补偿掉晃动带来的影响,从而确保视网膜上的成像始终保持稳定。

爱观视觉此次发布的BinoSense系列仿生眼,其核心突破正是将这套生物学机制转化为可靠的工程现实。据技术相关负责人介绍,本次推出的三款产品——BinoSense P320、S520仿生双眼视觉系统以及R301仿生机器人平台——构成了一个清晰的梯度布局:面向前沿研究的实验平台、可直接集成于机器人的成品仿生眼模块,以及完整的仿生机器人整机。它们的集体亮相,标志着仿生眼技术正从理论探索走向规模化应用,为机器人真正装上那双“会动、会看、会理解”的眼睛,迈出了实质性的一步。

具体来看,S520定位为高性能科研平台,它完整复现了人眼的六自由度运动结构,能够精准模拟人类双眼的各种复杂运动模式。这套系统主要服务于高校和科研机构,用于进行仿生视觉控制算法的深度研究与验证。P320则是一款高度集成化的产品级模块。它采用了更紧凑、更轻便、响应更快也更省电的并联式结构,可以直接集成到各类机器人头部或四足机器人身上,是真正走向实际应用的“即插即用”视觉解决方案。而R301,则是一个完整的人形机器人平台。它不仅搭载了P320作为其视觉系统,更整合了语音交互、表情表达、多传感器扩展等丰富功能,提供了一个开箱即用的仿生智能研究载体。

让机器人看懂世界

为什么这项进展值得业界关注?原因在于,仿生眼的价值,远不止于让机器人“看得更像人”那么简单。

相关负责人指出,在当下火热的具身智能领域,感知能力是公认的核心瓶颈之一。大语言模型让机器人“听懂”了指令,先进的运动控制技术让机器人“能动”起来,但在“看懂”并理解三维物理世界这件事上,现有方案仍存在明显短板。

试想,一台具身智能机器人如果仅依赖固定摄像头感知环境,它在复杂、动态的真实场景中表现必然受限。它无法在自身晃动时稳定识别目标,难以在远距离观察和近距离操作间快速切换焦点,更无法像人类一样,通过目光的移动与周围环境进行主动、智能的交互。

仿生眼技术,恰恰瞄准了这个痛点。它并非简单地为机器人增加一个传感器,而是从根本上重新定义了机器人的感知范式——从被动的“拍摄静态照片”,升级为主动的“观察和理解动态世界”。

正如张晓林所言:“仿生眼不只是‘看’,更能理解、跟踪、适应复杂环境。”这句话的关键在于“适应”二字。传统的固定相机要求环境来适应它:需要充足的光线、极小的晃动、目标必须出现在预设的视野框内。而仿生眼恰恰相反,它能够主动去适应环境:光线不足时可模拟瞳孔机制调整进光量,本体晃动时启动稳像功能保持画面清晰,目标距离变化时则动态调节双眼的聚散度。这种与生俱来的环境适应性,才是未来“具身智能”所亟需的真正视觉底座。

从实验室到产业,还有多远?

从行业视角观察,仿生眼技术目前无疑仍处于产业化的早期阶段。P320和R301的发布,标志着这项技术跨出了从实验室走向规模化应用的关键一步,但这仅仅是一个开始。接下来的道路依然充满挑战:如何进一步优化成本,让仿生眼从高端“选配”变为机器人的普惠“标配”;如何在更极端、更复杂的工况下确保其长期运行的可靠性;又如何与上层的人工智能大模型、决策规划系统进行更深度的融合,形成感知-决策-执行的完整闭环。

尽管前路漫漫,但方向已然清晰。未来的智能机器人,必将拥有一双可以灵活转动、主动注视、深度理解世界的眼睛——无限接近人类的眼睛。当那一天到来时,机器人感知世界的方式,或许会比我们当下想象的,更加生动、更加智能,也更加“人性化”。

原标题:《像人眼一样看懂世界,机器人的这双“眼睛”全球首发》

栏目主编:祝越 文字编辑:张晓鸣

来源:作者:文汇报 王宛艺

免责声明:正软商城发布此文仅为传递信息,不代表正软商城认同其观点或证实其描述。

产品推荐

-

售后无忧

立即购买>- DAEMON Tools Lite 10【序列号终身授权 + 中文版 + Win】

-

¥150.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Ultra 5【序列号终身授权 + 中文版 + Win】

-

¥198.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Pro 8【序列号终身授权 + 中文版 + Win】

-

¥189.00

office旗舰店

-

售后无忧

立即购买>- CorelDRAW X8 简体中文【标准版 + Win】

-

¥1788.00

office旗舰店

-

正版软件

正版软件

- 现代汽车IONIQ艾尼氪入华启新篇 以本土化设计科技打造专属电动出行宇宙

- 现代汽车集团旗下IONIQ品牌正式入华,发布两款中国设计概念车 汽车圈又迎来一位重量级玩家。现代汽车集团近日宣布,其高端电动化品牌IONIQ(艾尼氪)正式进军中国市场,并同步亮相了两款由中国设计团队主导研发的新能源概念车——VENUS CONCEPT(金星)与EARTH CONCEPT(地球)。这可

- 18分钟前 0

-

正版软件

正版软件

- SKN 推出 59g 中小手鼠标朱雀-惊碳:复合碳纤维外壳,PAW3315

- SKN 推出 59g 中小手鼠标朱雀-惊碳:复合碳纤维外壳,PAW3315 今晚八点,游戏外设市场将迎来一位轻量级选手。SKN品牌正式发布其新款鼠标——朱雀-惊碳。这款产品直接将重量控制在了53克,目标直指中小手型用户。其核心卖点,在于采用了激光雕刻工艺的复合碳纤维外壳,并搭载了原相PAW3315传

- 18分钟前 0

-

正版软件

正版软件

- 小米推出“米家空调巨省电 2026 款大 1 匹”:提供 740m³/h 风量,1699 元

- 小米“巨省电”空调新品上架,预售开启,国补后入手价颇具吸引力 关注家电市场的朋友可能已经注意到了,小米近期在京东平台上架了一款名为“米家空调巨省电 2026 款大 1 匹”的新品。这款空调定于4月17日正式首销,目前的预售价为1699元。更值得留意的是,在部分符合条件的地区,叠加国家以旧换新补贴后,

- 18分钟前 0

-

正版软件

正版软件

- 超频三推出南岳SR700全塔工作站机箱

- 超频三南岳SR700全塔工作站机箱上架,兼容性与扩展性拉满 最近,超频三在天猫平台上架了一款面向工作站和高端玩家的新机箱——南岳SR700。目前商品页显示的还是占位符价格,但产品的基本规格和设计已经一览无余。 这款机箱最大的亮点,无疑是其惊人的兼容性。它不仅能轻松容纳HTPX、SSI-EEB这类服务

- 19分钟前 0

-

正版软件

正版软件

- 美国索菲亚大学走进南京这所高校,带来四场学术盛宴

- 美国索菲亚大学代表团访问南京航空航天大学金城学院 共探学科共建与教育转型 4月13日,南京航空航天大学金城学院迎来了一批远道而来的客人——美国索菲亚大学校长Carol Humphreys博士率领的代表团。此次访问并非简单的礼节性会晤,而是一场围绕学科建设、国际交流与未来教育形态的深度对话。双方通过校

- 19分钟前 0

最新发布

-

1

1

- 在哪里可以找到手机相片收藏

- 517天前

-

2

2

- 详细解读I7-14650HX的性能评测数据

- 524天前

-

3

3

- 如何选择DP接口版本: 1.2还是1.4?

- 535天前

-

4

4

-

5

5

- 华为GT4和Watch4,哪个更好?

- 826天前

-

6

6

- 骁龙芯片的型号与天玑9400相当?

- 543天前

-

7

7

-

8

8

-

9

9

- 三星“约谈”联发科 A系列智能手机有望搭载其5G芯片

- 2321天前

相关推荐

热门关注

-

- Xshell 6 简体中文

- ¥899.00-¥1149.00

-

- DaVinci Resolve Studio 16 简体中文

- ¥2550.00-¥2550.00

-

- Camtasia 2019 简体中文

- ¥689.00-¥689.00

-

- Luminar 3 简体中文

- ¥288.00-¥288.00

-

- Apowersoft 录屏王 简体中文

- ¥129.00-¥339.00