Rubber Duck功能缩小Claude Sonnet与Opus性能差距74.7%

发布于2026-04-25 阅读(0)

发布于2026-04-25 阅读(0)

扫一扫,手机访问

GitHub Copilot CLI新功能:引入“第二意见”审查,AI编程性能飙升近75%

最近,GitHub Copilot团队放了个大招。4月6日,他们公布了一项名为“Rubber Duck”的实验性功能,直接为其命令行工具Copilot CLI装上了“双大脑”。这项设计的核心,是引入跨越不同模型家族的“第二意见”审查机制。效果如何?官方数据显示,AI的代码处理性能提升幅度,一度接近75%。

这背后直指一个核心痛点:在代码规划和生成的最初阶段,智能体一旦做出错误决策,这个错误很容易像滚雪球一样,在后续步骤中被不断放大。而单一AI模型进行自我审查,又难免困于自身的训练数据和思维定式,有些盲点靠自己真的很难发现。Rubber Duck功能的思路很巧妙——与其让一个模型“闭门思过”,不如请来另一个“出身”不同的模型作为独立审查员,用差异化的视角来挖出那些潜在的问题。

那么,这个“第二大脑”是怎么工作的?它采取的是跨模型家族组合的策略。举个例子,如果你选择Claude系列模型作为主导智能体,那么Rubber Duck就会自动调用GPT-5.4来担任审查者。后者的核心任务,就是对前者的工作计划和输出进行审视,并提交一份高价值的“关注点清单”。这份清单里,通常包含了被遗漏的关键细节、值得推敲的底层假设,以及那些容易出错的边界情况。

光有想法不够,还得看疗效。GitHub团队使用了SWE-Bench Pro这个权威基准进行测试。他们对比了Claude Sonnet 4.6和更强大的Claude Opus 4.6单独运行时的性能差距,结果发现:当为Sonnet 4.6配上Rubber Duck审查后,它竟能追回两者间高达74.7%的性能差距。这个数字,足以说明“第二意见”的价值。

尤其是在那些真正棘手的任务上,比如涉及3个以上文件修改、或者需要超过70步操作的复杂问题时,搭配了Rubber Duck的智能体得分比基线高出3.8%。在实际案例中,这个机制成功揪出了不少深层隐患,包括架构上的逻辑漏洞、循环覆盖错误,以及跨文件间的隐性冲突。

为了适应不同的开发场景,Rubber Duck提供了三种协作模式:主动、被动和用户触发。系统会在几个关键节点自动寻求审查,比如智能体制定完计划后、完成一段复杂实现后,或者编写完测试用例后。当然,如果智能体陷入“思考循环”,系统也会被动触发审查介入。为了确保整个过程透明可信,开发者也可以随时手动请求一次审查,Copilot会清晰地展示审查反馈内容以及相应的修改建议依据。

目前,这项充满潜力的功能已经以实验模式上线。想尝鲜的开发者,只需安装GitHub Copilot CLI,然后运行 /experimental 命令即可启用。启用后,选择Claude作为主模型,并确保拥有GPT-5.4的API访问权限,就能亲身体验“双脑协奏”带来的编程效率飞跃了。

免责声明:正软商城发布此文仅为传递信息,不代表正软商城认同其观点或证实其描述。

产品推荐

-

售后无忧

立即购买>- DAEMON Tools Lite 10【序列号终身授权 + 中文版 + Win】

-

¥150.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Ultra 5【序列号终身授权 + 中文版 + Win】

-

¥198.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Pro 8【序列号终身授权 + 中文版 + Win】

-

¥189.00

office旗舰店

-

售后无忧

立即购买>- CorelDRAW X8 简体中文【标准版 + Win】

-

¥1788.00

office旗舰店

-

正版软件

正版软件

- 小米挖角特斯拉高管或为2027年进军欧洲市场做准备

- 小米挖角特斯拉欧洲高管,剑指2027年欧洲市场 欧洲新能源汽车市场的棋局上,又添一枚关键落子。主角是中国科技巨头小米,而它新招募的“棋手”,是来自行业标杆特斯拉的重量级人物。 最新消息确认,小米已正式聘请特斯拉中欧地区交付运营高级经理迪特·洛伦茨,由其担任全新的欧洲交付与物流负责人一职。这一动作,被

- 8分钟前 0

-

正版软件

正版软件

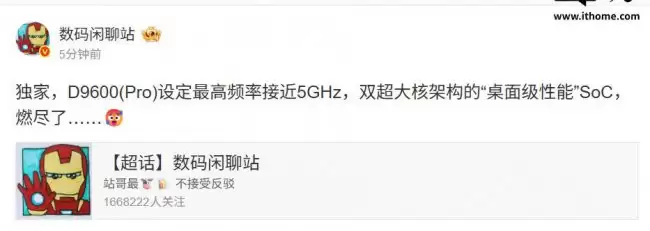

- 联发科天玑 9600(Pro)性能全面提升双超大核架构最高频率近 5GHz

- 博主 @数码闲聊站 今日爆料了联发科最新旗舰处理器 —— 天玑 9600 和 9600 Pro 的配置: 根据最新爆料,联发科下一步旗舰芯片天玑 9600 系列,可能会把性能上限推向一个新高度。爆料原文直指其核心频率设定“接近 5GHz”,并且采用了双超大核架构,目标是实现所谓“桌面级性能”。这个野

- 8分钟前 0

-

正版软件

正版软件

- Modos发布13.3英寸3.2K墨水屏显示器支持手写笔与60Hz刷新率

- 不只是护眼:这款墨水屏显示器,想碘伏你的工作流 在Kickstarter上,海外厂商Modos新上架的Flow墨水屏显示器,引起了不少数码爱好者和专业人士的关注。它不止是一块“护眼”的屏幕,更想成为你桌面上的多面手。 核心的硬件参数颇具诚意:它搭载了一块13.3英寸的3.2K E-Ink面板。要知道

- 9分钟前 0

-

正版软件

正版软件

- 全彩 RGBBitFenix 火鸟发布霓虹水冷 Glanz

- BitFenix Glanz AIO水冷:当RGB“入侵”每一条水冷管 机箱内的“光污染”竞赛,看来要进入一个新阶段了。BitFenix火鸟科技本月推出的Glanz一体式水冷,就带来一个相当吸睛的设计:它不仅在冷头和风扇上布置了RGB灯效,就连那两条水冷管,也裹上了霓虹般的光效。这意味着,流光溢彩不

- 9分钟前 0

-

正版软件

正版软件

- 小米 REDMI K90 Max 手机风冷散热参数公布:独立密闭风道 支持 IP66/IP68/IP69 整机防尘防水

- Redmi K90 Max 散热系统详解:一款为极致性能而生的手机 就在今天,Redmi官方正式揭晓了K90 Max手机散热系统的核心参数。这套方案远非简单的“堆料”,而是围绕“高效能持久输出”这一目标,进行了一系列精密设计。其中最引人注目的,莫过于它支持IP66/IP68/IP69级别的整机防尘防

- 10分钟前 0

最新发布

-

1

1

- 在哪里可以找到手机相片收藏

- 518天前

-

2

2

- 详细解读I7-14650HX的性能评测数据

- 525天前

-

3

3

- 如何选择DP接口版本: 1.2还是1.4?

- 536天前

-

4

4

-

5

5

- 华为GT4和Watch4,哪个更好?

- 827天前

-

6

6

- 骁龙芯片的型号与天玑9400相当?

- 544天前

-

7

7

-

8

8

-

9

9

- 三星“约谈”联发科 A系列智能手机有望搭载其5G芯片

- 2322天前

相关推荐

- 小米挖角特斯拉高管或为2027年进军欧洲市场做准备

- 联发科天玑 9600(Pro)性能全面提升双超大核架构最高频率近 5GHz

- Modos发布13.3英寸3.2K墨水屏显示器支持手写笔与60Hz刷新率

- 全彩 RGBBitFenix 火鸟发布霓虹水冷 Glanz

- 小米 REDMI K90 Max 手机风冷散热参数公布:独立密闭风道 支持 IP66/IP68/IP69 整机防尘防水

- 荣耀 X14 Plus、X16 Plus 将于 4 月 23 日发布

- 大势所趋:欧加 / iQOO / REDMI / 荣耀性能机均支持超高刷 曝《王者荣耀》也在适配 165 帧模式

- 三星电子采用低温焊料解决 SOCAMM2 量产翘曲问题

- 内存价格狂泻!DDR5最高降22%:创下四个月新低

热门关注

-

- Xshell 6 简体中文

- ¥899.00-¥1149.00

-

- DaVinci Resolve Studio 16 简体中文

- ¥2550.00-¥2550.00

-

- Camtasia 2019 简体中文

- ¥689.00-¥689.00

-

- Luminar 3 简体中文

- ¥288.00-¥288.00

-

- Apowersoft 录屏王 简体中文

- ¥129.00-¥339.00